人多不管用——智能体团队别盲目扩张

2026-04-21 17:25:30 · chineseheadlinenews.com · 来源: 新智元

随着大语言模型(LLM)驱动的多智能体系统快速发展,越来越多的系统被用于软件工程、科学分析、网页自动化、组织协作和社会模拟等任务。但一个核心问题始终没有被系统回答:为什么有些智能体架构可以支持长链条、多步骤任务,而另一些系统在规模扩大后会失稳、低效,甚至失去协调能力?这篇综述试图回答的,正是大规模智能体系统为何能扩展、为何会失稳,以及未来该如何设计更可扩展的系统结构。

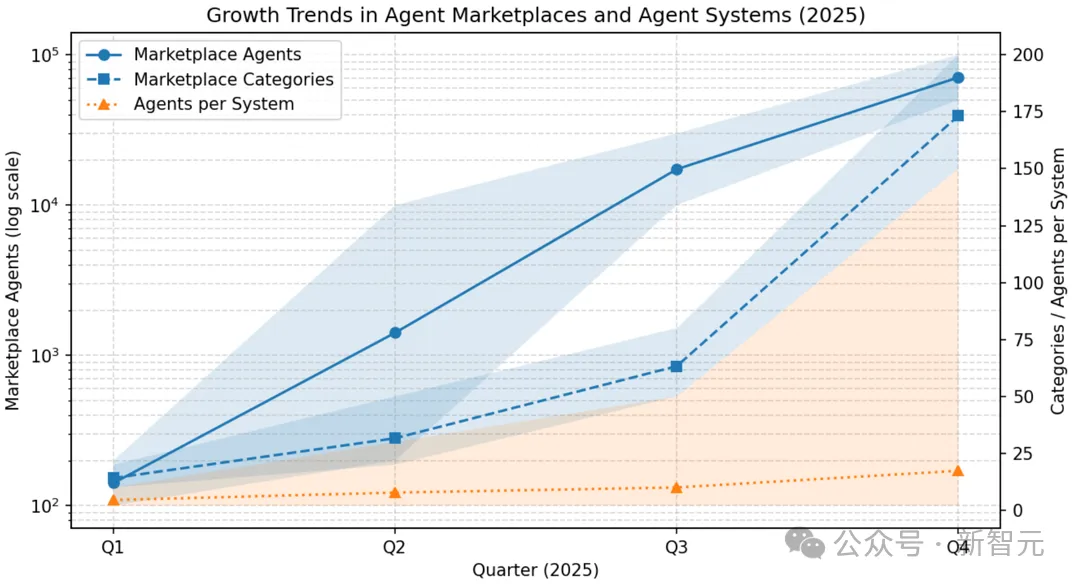

近年来,agent marketplace和agent system都在快速扩张。

一方面,智能体市场中的可用agent数量和类别不断增长;

另一方面,真实部署的agent system也从少量角色协作,逐步走向包含数十个甚至数百个agent的复杂结构。

这意味着,大规模智能体系统已经不再只是实验室中的小辨模演示,而正在进入更开放、更持续、更复杂的真实运行环境。

图1 2025年智能体市场与智能体系统增长趋势。市场中的智能体数量采用对数坐标显示,市场类别数和每个系统中的智能体数采用单独坐标轴显示,阴影区域表示估计范围。数据来源: Internet Archive(Wayback Machine)存档网页快照,包括OpenAI GPTs、AWS Marketplace和Agent.ai。

图1展示了这一趋势:无论是marketplace中的agent数量,还是system中每个任务链所涉及的agent数,都在明显增长。也正因为如此,研究者不能再只关注单个agent的能力,而必须开始回答一个更系统的问题:当agent数量、类型和交互复杂度同时上升时,系统层面的行为究竟由什么决定?

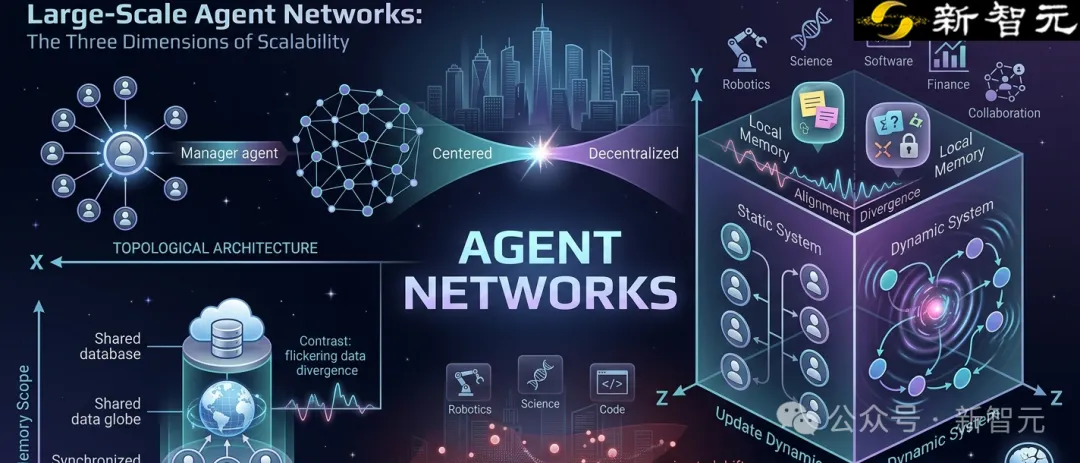

美国埃默里大学(Emory University)、英国牛津大学(University of Oxford)和澳大利亚格里菲斯大学(Griffith University)的研究人员提出了一套三维分类框架,用来统一描述大规模智能体网络。

第一维是架构拓扑(topology),即系统是中心化(centralized)还是去中心化(decentralized);

第二维是记忆范围(memory scope),即信息存放在全局记忆(global memory)还是局部记忆(local memory)中;

第三维是更新行为(update behavior),即系统在运行中是静态(static)还是动态(dynamic)的。三者组合后,一共得到八类典型的大规模智能体网络。

论文链接:https://www.techrxiv.org/doi/full/10.36227/techrxiv.177127384.46731320/v1

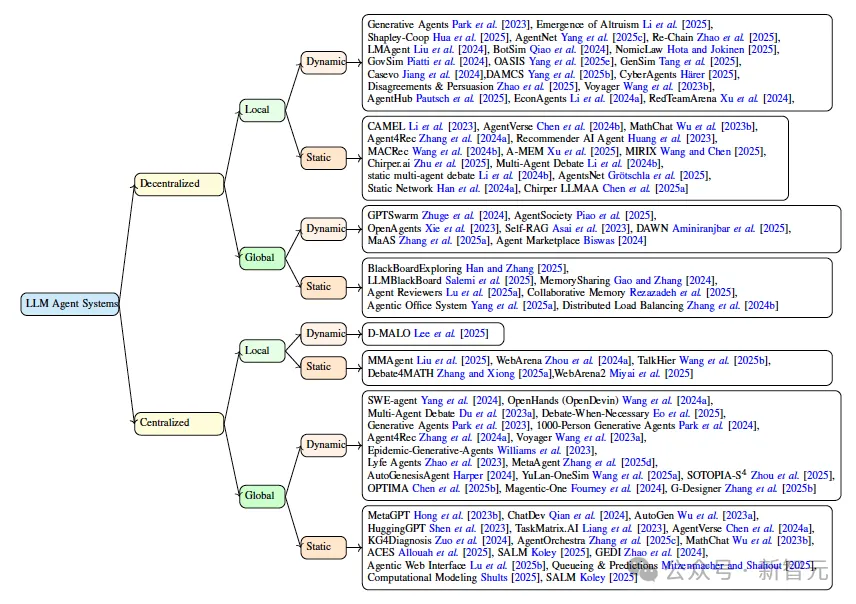

为更直观地展示这套分类框架,作者将现有大规模智能体系统按照“拓扑(topology)—记忆范围(memory scope)—更新行为(update behavior)”三个维度组织成一张层级结构图。通过这张图可以看到,不同系统虽然都属于多智能体范式,但它们在中心化或去中心化、全局记忆或局部记忆、静态或动态更新上的选择并不相同。这些结构差异进一步决定了系统在协调效率、扩展性、鲁棒性和长期行为上的不同表现。

图2 大规模智能体网络的三维分类框架:基于拓扑(topology)、记忆范围(memory scope)与更新行为(update behavior)的层级组织

图2可以看作这篇综述的核心。文章强调,真正决定系统表现的,往往不是智能体数量本身,而是这三种机制如何组合。

中心化系统(centralized systems)更容易统一调度和维持一致性(consistency),适合任务流程明确的场景,但规模变大后容易出现中心瓶颈(central bottleneck);去中心化系统(decentralized systems)更灵活,更适合研究群体涌现(emergence)行为,但也更容易出现局部失调(local miscoordination)和信息漂移(information drift)。

全局记忆(global memory)有利于共享上下文(shared context)和状态对齐(state alignment),局部记忆(local memory)更贴近真实分布式环境(distributed environment),但也更容易带来分歧。

静态系统(static systems)更容易分析和复现,动态系统(dynamic systems)则更适合复杂环境中的长期任务(long-horizon tasks)和自适应协作(adaptive collaboration)。

在此基础上,文章还进一步提出了一个很重要的判断:通信协议(communication protocol)虽然重要,但不是大规模智能体网络最深层的瓶颈。作者指出,更根本的问题是智能体之间世界模型(world model)的不一致。

即使消息传输完全正确,不同智能体也可能因为内部知识、偏好和记忆不同,而对同一句话或同一个状态做出不同解释。换句话说,传输正确,并不等于理解一致。

这种不一致会在系统中逐层放大:在认知层面,会形成信念漂移(belief drift);在行为层面,会带来合作不稳定;在任务层面,会造成目标偏移(goal divergence);在系统层面,则可能形成非平稳动态(non-stationary dynamics),使整个网络难以收敛。

基于这些观察,作者认为未来研究需要更关注几个方向:更明确的一致性模型(consistency model)、更强的共享状态控制(state control)、更成熟的路由与通信调度机制,以及面向开放环境的身份、安全和鲁棒性设计。

文章还指出,现有评估体系远远不够,因为多数基准仍停留在小辨模,而未来真实系统可能需要面对上千到上百万智能体!

总体来看,这篇综述的价值不只是总结已有工作,更在于给大规模智能体网络研究提供了一张结构地图。它提醒我们:未来系统要真正扩展,关键不只是增加智能体数量,而是要解决拓扑、记忆、更新机制和世界模型对齐之间的系统性问题。