菲尔兹、诺贝尔、图灵奖同台:AI正在改变科学

2026-02-25 01:25:17 · chineseheadlinenews.com · 来源: 高飞的电子替身

又是一个比较烧脑的AI笔记。

2026年2月10日,UCLA的数学科学研究所IPAM举办了一场学术聚会。菲尔兹奖得主陶哲轩、诺贝尔物理学奖得主Barry Barish、图灵奖得主、强化学习之父Richard Sutton,与来自OpenAI、微软研究院、NVIDIA、AWS的技术负责人,以及宾大、布朗、USC等学者同台,花了整整一天讨论AI For Science:也就是AI究竟在以什么方式改变科学?

这个话题可能和普通AI用户关系不大,但是和AI产业的发展速度紧密关联。

可以这样说,过去一两年多,全球最大AI公司的掌门人几乎不约而同地把"科学发现"推到了通向AGI的核心路径上。

山姆·奥特曼(Sam Altman)2026年2月在斯坦福对学生说:"如果你现在是大二,毕业时世界上就会有AGI。"达里奥·阿莫代伊(Dario Amodei)在2025年初的达沃斯论坛上预测,AI可能将生物学未来50到100年的进展压缩到5到10年内完成。2024年诺贝尔化学奖得主德米斯·哈萨比斯(Demis Hassabis)2026年2月接受《财富》采访时的措辞更大:未来10到15年人类将进入"新文艺复兴"。哈萨比斯这在印度AI峰会还提出一个爱因斯坦测试,如果把AI的训练数据卡在1911年,如果模型能推导出相对论,那就是AGI了。

三个人用不同的词汇指向同一件事:AI正在从辅助工具变成科学发现的主体参与者。OpenAI 2025年底发布的FrontierScience基准测试就是为了衡量这种能力。在《时代》杂志对该基准的报道中,本次活动的演讲者Sébastien Bubeck透露,他把一个困扰自己和学生多年的数学问题交给GPT-5,"让它思考了两天,里面出现了一个奇迹般的恒等式,模型真的解出来了。"

所以,AI for Science不是一个简单的学术愿景,而是通向AGI的主战场。

这场名为"AI for Science Kickoff 2026"的活动,是SAIR基金会(Foundation for Science and AI Research)的首次公开活动。SAIR由陶哲轩联合发起,使命是双向的:用AI加速科学发现,同时用科学方法约束AI。活动由IPAM、UCLA物理科学学院和SAIR联合主办,仅限受邀嘉宾现场参加,但会对外提供演讲内容。

我个人觉得,这场活动值得用长文记录,还有一个理由是因为这些科学家谈论AI的方式和科技产业界完全不同。他们讲话极有结构感,而且习惯性地用自己学科里最精确的术语做类比,来拆解那些在公共讨论中早已模糊的概念。

比如USC工程学院院长Yortsos在讨论"AI会不会让学习变容易"时,搬出的化学动力学:AI是催化剂,催化剂降低的是活化能,但学习本身是吸热反应,该投入的总能量一点没少。 一句话就把"AI让上手更容易"和"AI替你省掉了思考"这两件事切得干干净净。

整场活动里这样的时刻反复出现,每位科学家都在用自己最熟悉的认知工具拆解AI,而这些拆解往往比硅谷的宏大叙事更有穿透力。

一天下来,能考到的现象是:AI对不同学科的穿透力极不均匀。数学因为拥有形式化验证这把"安全网",正在大步拥抱AI协作;物理学因为方法论上对统计显著性的刚性依赖,与AI几乎处于"过敏"状态;产业界已经在用AI两天证出卡了十年的定理;而美国高等教育,正在经费危机和AI冲击的双重压力下寻找生存路径。不过这种现象也合理,毕竟现在的AI被称作锯齿智能。

但是这个锯齿智能正充当不同学科的黏合剂。一位科学家在会上说:经过近百年的超专业化之后,数据科学和AI正在把不同学科重新拉到一起。

1. 陶哲轩:数学200年没怎么变,现在终于动了

陶哲轩(Terence Tao),UCLA数学教授,菲尔兹奖得主,被广泛认为是当今在世最杰出的数学家之一。

他的开场切入了一个容易被忽略的事实。数学这个学科,在实践层面极其保守。他展示了一页1825年柯西的复分析论文,除了用法语写的、不是LaTeX排版,内容和今天的教材几乎一模一样。两百年了,数学家还在用黑板推导,还在小团队里一个问题磨几个月。他拿出一张不同学科论文合著者数量的对比图:物理学和化学的合作规模早就膨胀了,数学还卡在一两个人的模式里。

原因并非数学家不合群。陶哲轩解释了结构性障碍:数学对证明正确性的要求极高,每一步都必须绝对正确。一个十人团队里如果有一个人的论证不可靠,要么所有人互相验证(极其耗时),要么整个协作失败。黑板非常适合两三个人面对面推导,但对20人、50人跨国协作毫无用处。"我们无法在Zoom上解决数学问题。"

转折来自形式化验证(formal verification),一种让计算机自动检查证明每一步是否正确的技术,使用的编程语言叫Lean。过去,把一个用自然语言写成的数学证明翻译成Lean代码需要几周。现在,AI辅助下可以压缩到几小时。这意味着即使大量贡献来自AI或非专业人士,只要最终能编译通过Lean验证,结果就是可信的。

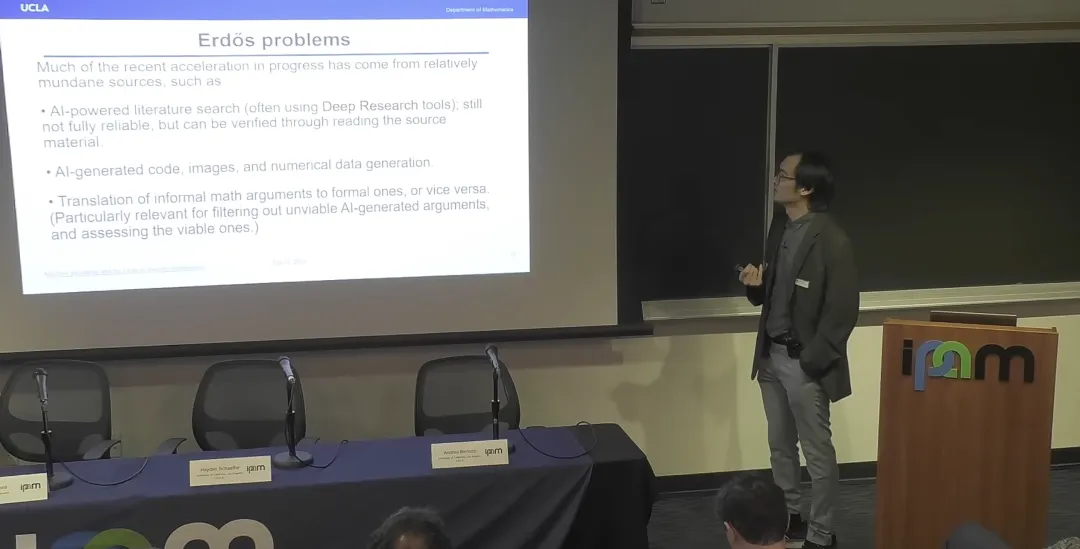

陶哲轩用Erd?s问题作为案例。Paul Erd?s是20世纪最多产的数学家,留下约1000个未解问题,有些极其深刻(他称之为"硬核桃"),有些其实不难,只是没人认真看过(他称之为"棉花糖")。从2025年9月开始追踪以来,AI工具已经帮助解决或推进了其中约100个问题。

他讲了一个典型的人机协作故事。Erd?s问题#367:一个人类贡献者在论坛上提出了一个构造,但证明中缺一个关键步骤,一个同余等式。陶哲轩把这个等式丢给了Gemini,十分钟后得到了完整证明(用了p进赋值理论,一种数论中处理质数整除性的分析方法,比实际需要的技术复杂得多)。他花半小时把证明简化成初等版本发到论坛。第三个人用Aristotle(一个AI驱动的形式化工具,能自动将数学证明转写为Lean代码)把它转成了机器可验证的版本,自动通过。三个人、两个AI工具、一天之内,一个公开问题就这样关闭了。

另一个更戏剧性的案例是Erd?s问题#1026,一个关于最优硬币分堆的组合优化问题。陶哲轩用Google的AlphaEvolve(一种用大语言模型引导的进化搜索工具,擅长在巨大解空间中找最优构型)搜索出了n≤16的最优构型,据此提出猜想。另一位协作者简化了猜想,第三位发现这个函数恰好和一个刚被解决的正方形填充问题完全一致,把这些片段拼在一起,问题解决了,并且已经在Lean中形式化。

"AI已经在以我们从未见过的规模和速度改变数学的做法," 陶哲轩总结说。"但关键是,你需要一个系统化的问题集合。一旦有了好的数据集,各种工具和各种人都会冒出来做出意想不到的贡献。"他强调,目前AI对最顶尖的难题还无能为力,但对"长尾"中大量中等难度问题,效果已经非常显著。"有些问题实际上被高中生用AI解决了,我们能确认,因为证明在Lean里通过了。"

2. Barry Barish:物理学和AI有点过敏反应

Barry Barish,加州理工学院荣休教授,2017年诺贝尔物理学奖得主,因领导LIGO探测器建设并首次直接探测到引力波而获奖。

如果说陶哲轩带来了乐观,Barish带来的则是一盆冷水。

他先把物理学在人类文明中的位置铺陈了一遍:激光源于爱因斯坦的理论,MRI源于核物理发现,上个世纪最重要的技术进步几乎都始于最基础的物理研究。然后话锋一转:"AI在物理学里的进展远比你想象的慢。我们到处在用它,但我不认为它在真正推动科学前沿。"

问题的核心是统计显著性。物理学判断一个发现是否成立,靠的是传统统计方法,你必须给出精确的置信度数字。发现希格斯玻色子用的是5 sigma标准(sigma是标准差,5 sigma意味着观测结果偏离零假设超过5个标准差),换算成概率就是随机误判的可能性不超过350万分之一。而神经网络本质上是黑箱,它能告诉你"很可能是",但无法给出统计置信度。"这就是限制所在,"Barish的原话是,"物理学和AI基本上是过敏反应(不相融)。"

不过,如果把目光从核心科学判断移开,看AI对物理学的间接作用,画面就完全不同了。

Barish接下来用LIGO的实际经验展开了这一层。LIGO是一种激光干涉引力波天文台,通过测量两条互相垂直的四公里长激光臂之间极微小的长度差异来捕捉引力波。2015年首次探测到引力波时,LIGO测量的精度达到了10的负21次方,换算成实际位移,相当于探测到比原子核还小一万倍的变化。实现这个精度需要解决两个核心问题:干涉测量精度比此前任何干涉仪高出七到八个数量级;同时必须将地球自身的振动隔离到10的负12次方。

LIGO传统上用模板库做信号识别,根据爱因斯坦方程预算约25万种可能的双天体合并波形,逐一与实际数据比对。AI在这里的用处是用卷积神经网络(CNN,一种擅长识别信号模式的深度学习架构)做快速匹配,把判断时间从数小时缩短到几分钟。这对多信使天文学至关重要。所谓多信使天文学,就是同时用引力波、电磁波、中微子等不同"信使"观测同一天文事件,因为有些电磁信号转瞬即逝,晚几小时通知天文学家就来不及了。

2017年的双中子星合并事件是最好的例子。

LIGO探测到引力波信号后约1.5秒,卫星检测到了伽马射线暴。这两个信号来自1.5亿光年之外,时间差仅约一秒。换一种说法:1.5乘以10的15次方秒的旅程中相差一秒,直接证明了光和引力波以相同速度传播。此后全球天文台在从射电到X射线的全波段追踪了这个事件,发现它符合"千新星"模型(kilonova,两颗中子星合并时抛出大量富含中子的物质,在衰变过程中发出可见光),并且一次事件产生了约100个地球质量的黄金。这解决了一个困扰地质学几十年的问题:比铁重的元素到底从哪来?答案可能不是超新星,而是中子星合并。

"在所有这些过程中,AI扮演的角色是加速判断,"Barish说。"有用,但不是革命性的。最终确认都靠传统统计方法。"他指出,LIGO现在也在用AI辅助光学设计、信号处理优化和下一代探测器的工程设计,但这些都是"增量式"的改进。真正的科学突破,比如探测宇宙大爆炸极早期的引力波,需要的是全新的探测器概念(比如2035年左右发射的LISA,一个由三颗卫星组成、臂长250万公里的欧洲空间引力波探测器),而不是更好的数据分析算法。

3. 数学家圆桌:形式化证明速度在指数级飙升

陶哲轩主持了四位数学家的Panel讨论:Hayden Schaeffer(UCLA,研究AI求解偏微分方程和从数据中发现物理定律)、Damek Davis(宾夕法尼亚大学,优化算法理论)、Deanna Needell(UCLA,数据科学与公平性算法)、Andrea Bertozzi(UCLA,图论和计算化学应用数学)。

Davis的时间线令人震撼。 2023年11月,他试图用当时最强的GPT-4在Lean中形式化一个梯度下降收敛性证明(梯度下降是机器学习中最基础的优化算法,其收敛性证明是优化理论的入门级结果)。GPT-4完全做不到。此后他每隔几个月测试最新模型,直到2025年4月用O3、Gemini 2.5 Pro、Claude Code全部试了一遍,没有一个成功。2026年2月,他把同一个问题交给Aristotle(用GPT-5.2 Pro驱动),15分钟内生成了200行Lean代码,完整形式化了这个证明。从"完全不行"到"15分钟搞定",只用了两年。

他还讲了另一个经历。2025年1月,一位同事遇到一个学习理论问题,问遍了领域内的顶级专家,没人知道答案。Davis花了半年用各种LLM(大语言模型)尝试求解,到7月基本放弃,模型总是在关键步骤上犯错,把非平凡的论证当成"显然成立"跳过。一周后ChatGPT的agent模式发布,它建议了五篇论文,其中一篇的附录里包含了答案,藏在一篇完全不相关主题的论文里,用的是完全不同的关键词。七个月后,ChatGPT 5.2 Pro不仅独立证明了这个结果,还正确引用了文献,思考了66分钟后给出了完整解答。

Davis对AlphaEvolve的体验也很有代表性。他在Twitter上宣布要"直播"用AlphaEvolve解决一个关于自卷积不等式的常数优化问题,结果被困了整整五天,尝试了所有能想到的方法都失败了。这让他深刻体会到:大规模计算加上好的先验模型(LLM在解空间中的高效采样),对于中等规模的优化问题威力巨大,而且"不可预测",你不知道它什么时候会突然解出你卡住的问题。他预测未来一年内会出现大量"半自主"的数学发现。

Bertozzi从另一个角度强调了数学工具的价值。 她做的DNA适配体(aptamer)设计问题就是典型。适配体是一种能像抗体一样精确结合特定靶标的短链核酸分子,在诊断和药物递送中有广泛应用。她的方法是先用组合数学中的Motzkin路径(一种把DNA二级结构与数学对象一一对应的方法)把折叠形状转化为特征向量,再做机器学习。传统做法是看SELEX实验(一种通过反复筛选盎集高亲和力序列的实验方法)末端哪些序列计数最高,但她发现计数低的序列中也有结构几乎相同的候选物,只有用数学工具深入分析二级结构才能发现这些"隐藏"的优质分子。

她在一个生物科学知识图谱的子图匹配项目中,找到了10的18次方个精确匹配。面对这种天文数字级的组合复杂性,大多数人的直觉是绕道走。Bertozzi说不该绕:"组合复杂性应该正面进攻,而不是转身就走。" 她指出,数学能提供严格的结构等价性定义,并推导出组合公式来计数所有实例,让10的100次方级别的解空间在实际计算时间内变得可处理。

Schaeffer展示了用Transformer做通用PDE求解器的工作。 PDE即偏微分方程,是描述流体运动、热传导、量子力学等连续物理过程的基本数学语言。他训练模型在多种流体系统上学习,然后给它一个从未见过的新系统的10帧时空快照,让它预测后续演化,不告诉它这是什么方程、什么参数。误差仅5%。他的另一个方向是从数据中自动发现物理定律:给定原始数据,让AI告诉你支配方程是什么。最近他在做的工作结合了LLM的自然语言能力,不只输出方程,还能用人类可理解的语言解释系统行为,比如"这个系统会进入混沌态"或"数据趋向稳态"。

关于AI工具在数学家中的实际采纳,Davis提到一个有趣的观察:即使在研究AI理论的数学家群体中,真正在日常工作中使用AI工具的人直到2025年3月Gemini 2.5 Pro发布后才开始增多。很多人对新技术缺乏耐心。"他们期望它立刻比现有工具好,而我因为喜欢软件所以愿意忍受它。"他给同事展示自己写的详细prompt时,对方惊讶于需要写那么长的指令。"上手曲线很陡,"他说,"但正在快速变平。"

4. Richard Sutton:当前AI是知识巨人、心智侏儒

Richard Sutton,阿尔伯塔大学教授,Open Mind Research Institute创始人,强化学习领域奠基人,合著的《Reinforcement Learning: An Introduction》是该领域圣经级教材。远程参会。

下午的产业和哲学环节以Sutton的远程演讲开场,他对当前AI热潮的评估出乎多数人意料。

"所有人都觉得AI在飞速进步,当所有人想法一致的时候,我们应该质疑它。"他开场说。他承认语言模型是真突破,没人料到神经网络能如此熟练地使用语言。但生成图像和视频?"这是心智从来不需要做的事。我们需要处理图像,但不需要生成图像。"大量被称为"智能"的成就,本质上只是大规模计算和大规模模式识别。

他提了一系列定义来锚定讨论。威廉·詹姆斯(心理学创始人,1890年)说过:"心智的标志是通过多变的手段达成不变的目标。"AI创始人约翰·麦卡锡的定义是:"智能是达成目标的能力的计算部分。"Sutton自己的定义则是:"通过适应行为来达成目标的能力。"关键词是"适应",学习的能力,而非仅仅拥有知识。

这把他引向了核心论点:当前AI处于"人类数据时代"。所有主流模型都是在人类产生的数据上训练的,互联网文本、图片、视频,然后由人类专家微调。训练完成后,模型就冻结了,不再学习。"这个方法的原理限制是它不能学到任何真正新的东西。"它能总结人类已有的知识,但不能生成全新知识。这就是为什么AI在最难的Erd?s问题上还推不动,那些问题需要的不是搜索已有文献,而是创造性的新论证。

他认为下一个时代是"经验时代",从交互中学习,而非从静态数据集学习。强化学习就是这个方向的核心技术:智能体在环境中行动、观察结果、获得奖励反馈,然后调整行为。这是动物学习的方式,也是AlphaGo下出"第37手"创造性着法的方式(在2016年与李世乭的第二局中,AlphaGo在第37手下出了一步人类棋手从未考虑过的棋,最终赢下比赛)。关键区别在于,经验数据随智能体能力的提升而不断增长和改善,永远不会用完。

"当前AI看起来很强大,实际上很弱," Sutton总结说,"它们是知识巨人,但心智侏儒。不可靠、不聚焦、东拉西扯。它们的强大仅仅来自拥有所有人类知识,而非来自真正的智能。"

在哲学层面,Sutton走得很远。他把宇宙历史分为四个时代:粒子时代、恒星时代、复制者时代(生物体通过复制繁衍但并不理解自身)、设计者时代(通过心智先构想再创造)。人类的独特角色是"把设计能力推向极致的复制者",而设计能力的终极形态,就是设计出自身也具有设计能力的存在。"这就是我们正在用AI做的事。"

5. 产业领袖圆桌:GPT-5.2两天证了一个卡十年的定理

主持人Chuck Ng(SAIR基金会联合创始人)引出了四家公司的技术负责人:Sébastien Bubeck(OpenAI技术负责人,前微软研究院AI副总裁,理论计算机科学家)、Hoifung Poon(微软研究院总经理,深耕生物医学AI十五年)、Jiantao Jiao(NVIDIA研究科学家,前UC Berkeley教授,斯坦福博士,负责后训练与科学发现方向)、Erran Li(AWS科学负责人,研究分子世界的AI推理模型)。

Bubeck带来了最具冲击力的演示。 他展示了一个悬而未决十年以上的组合数学问题。他把问题交给GPT-5.2 Pro,让它在两天的时间内完成思考和证明,结果不仅解出了问题,还给出了完整的形式化Lean证明。Bubeck坦言这不是他常规工作,他95%的时间在做模型能力研发,但他从中看到了重要的信号。

他对科学的角色做了一个精炼的三分法:技术(造东西、改善生活)、理解(纯粹想知道世界为什么是这样)、竞争(像游戏一样比谁先解出来)。AI对技术纯属加分。竞争方面,AI可能"杀死游戏的乐趣",机器比你解得快,比赛就没意思了。最微妙的是理解:AI可以给你正确答案甚至正确证明,但你读完仍然不知道"为什么是这样",认知上的满足感并没有到来。"我希望AI能迫使科学界重新把理解放回核心," 他说,"也许未来我们该少写论文,多做真正的知识整合和解释。"

Poon从生物医学的角度讲了一个漫长而诚实的故事。 他在微软研究院做了十五年生物医学AI。"我是作为NLP研究员被招进来的,但我告诉老板我想做癌症研究。奇迹般地他没有当场开除我。"十五年来进展缓慢,他说这是"战斗伤疤"。但现在生物学数据的爆发式增长,蛋白质结构、基因组、临床数据,终于让AI有了用武之地。

Jiao聚焦"世界模型"。 这个概念指的是一种用真实数据训练的生成式动态模型,它不模拟具体方程,而是从数据中学习系统演化的规律。Jiao把它定位在湿实验室(昂贵、不可复现)和传统仿真(需要把所有方程写清楚,复杂系统做不到)之间。核心能力有两个:支持干预查询,也就是"如果我改变这个条件会怎样",包括现实中难以操作的实验;以及校准的不确定性量化,模型知道自己哪里没把握,从而指导下一步该去做什么真实实验。AI指导实验、实验反哺AI,一旦这个闭环跑通,科学发现速度将根本性加速。

四人在讨论中对一个问题有分歧:AI辅助的数学成果是否应该以论文形式发表?Bubeck认为,很多被AI解决的问题以前就没有发表价值,"解了十个Erd?s问题不代表就值得发论文,得看解法本身是否有新意。"Davis从观众席加入讨论,态度更为实际:他认为半自主发现在一年内就会变得常见,"OpenAI在组建全美最强的CS理论团队,有最强的模型加上最强的人,这个趋势不会停。"

6. 高等教育:12亿美元冻结和AI冲击同时到来

最后一个环节情绪最复杂。主持人Miguel Garcia-Garibay(UCLA化学与生物化学教授、物理科学学院院长)开场就讲了一个美国学术界的残酷背景。

2025年6月某天,UCLA 12亿美元联邦研究经费突然被冻结。IPAM,举办本次活动的数学研究所,刚刚获得NSF(美国国家科学基金会,联邦政府资助基础科学研究的核心机构)推荐续拨五年经费,一夜之间变成了"我们没有钱了"。研究人员的工资、助教经费、博士后职位、实验室运转全部受到影响。正是在这个背景下,SAIR基金会应运而生,不仅出于对AI的热情,也是对学术体系脆弱性的应急响应。

这个脆弱性有多严重?Garcia-Garibay算了一笔账。培养一个STEM本科生到毕业,社会总投入约50万美元;培养到博士约110万美元;到博士后约180万到200万美元。Apple有5万名科学家和工程师,Meta有4万,NVIDIA有2万。仅这几家公司2024年的营收总计就接近6800亿美元,而美国全国STEM投资总额约2800亿美元。大学是产业人才基础设施的核心,但这个基础设施比大多数人意识到的要脆弱得多。

Jain(宾大Annenberg自然科学教席教授、Penn AI委员会联合主席,宇宙学家)展示了用扩散模型(diffusion model,一种通过逐步去噪生成数据的生成式AI方法,最初因图像生成闻名,现被广泛用于科学数据重建)做暗物质地图反演的工作,分辨率比传统方法高四倍,正在验证中。他还用了基于模拟的推断方法(simulation-based inference,用大量模拟数据训练模型来替代传统的似然函数计算),直接比较观测地图和理论预测地图,跳过传统的端点关联函数计算。"对某些物理学同事来说,这让他们非常紧张。"他坦言。但他对AI作为"认知伙伴"的角色最为兴奋:"真正的科学发现路径是什么?一旦一个理论不工作了,你怎么提出下一个问题?在这方面,AI还完全不确定是否能帮上忙。"

他还提供了一个引人注目的观察:经过近百年的超专业化之后,数据科学和AI正在把不同学科重新拉到一起。"我在宾大最兴奋的事情是和语言学的人聊天,让本科生跨学科做项目。这种跨领域协作的可能性是前所未有的。"

Rubenstein(布朗大学化学教授、数据科学研究所所长)强调了人机界面的挑战。她的研究横跨量子计算、蛋白质动力学和分子计算三个方向。"每当我的院长介绍我,总得先想一想我到底在哪个系。"她研究的核心问题之一是可解释性(interpretability,即理解AI模型内部的推理逻辑,而不仅仅看它给出什么结果):"模型预测对了,很好。但如果我不理解它为什么对了,那对科学来说是个问题。"她特别指出了agentic AI(能自主规划和执行多步骤任务的AI系统)对教育的冲击:过去培养学生成为房间里的唯一专家,但未来人类将和"AI军团"协作。"学生不仅要学会领导人类,还要学会领导机器。这是一个全新的界面。"

她的布朗数据科学研究所刻意保持了比"AI中心"更宽的定位:"我们叫数据科学研究所,因为数据比AI更基础。数据统一了所有学科。连人文学者都有数据。"研究所甚至设立了"技术责任与再想象中心",让历史学家和伦理学家参与AI的社会反思。"历史学家正在审视这个时刻,他们提出的问题比大多数技术人员提出的更深刻。"

Cornell的Peter Loewen同样参与了这场Panel,但限于篇幅,本文聚焦于涉及具体科学案例的讨论。

Yortsos(USC工程学院院长,化学工程教授)提供了最多的框架性思考。他把AI看作三个不同层次的存在:作为工具,就像搜索引擎升级版;作为催化剂,加速科学发现和学习过程;作为技术,他引用了Brian Arthur在2008年的定义,"技术是利用现象达成有用目的"。传统技术利用物理、化学、生物现象,AI利用的则是数据。"这就是为什么AI能横切所有学科,它把具体现象抽象掉了,只操作数据。"

前文提到的催化剂类比就出自他:AI降低活化能,但学习是吸热反应,该投入的总能量一点没少。换句话说,AI让你更容易上手,但该花的脑力不会因此减免。

他还提了一个动力学框架来判断创新的加速节奏:如果创新速度跟已有创新成正比(dA/dt ∝ A),你得到指数增长,就是摩尔定律,快但可预测;如果跟平方成正比(dA/dt ∝ A?),数学上你会在有限时间内撞上奇点,物理学叫相变(系统性质在临界点发生突变),"我们可能正处于向自主性的相变之中。"他由此对教育提出了一个尖锐问题:"如果科学发现在加速,PhD还需要五年吗?两年够不够?我们该怎么评估学生的成就?"

一天的讨论结束后,几个判断浮出水面。

AI对科学的穿透力取决于该学科是否有独立于AI的验证机制。 数学有Lean,所以可以大胆拥抱AI生成的证明,不管来源多不可靠,编译通过就是通过。物理学没有这样的自动验证,每个发现都必须回到统计显著性的硬标准,AI在这里只能当加速器,当不了裁判。

"只要AI仅能做到目前能做的事,就用它,但别信任超出你能验证的部分。" 陶哲轩在回答观众提问时说了这句话。这或许是整场活动最实用的一句总结。

核心问答

Q1: AI目前在数学中最大的实际贡献是什么?

最大贡献在于大规模扫清"长尾",那些因为没有足够人类注意力而长期悬而未决的中等难度问题。陶哲轩估计,目前约1-2%的未解Erd?s问题简单到AI可以在极少人类帮助下解决。更大的贡献是加速形式化验证(从数周压缩到数小时)和语义搜索(找到散落在不同领域、不同语言论文中的已有解答)。

Q2: 物理学为什么比数学更难被AI渗透?

核心障碍是统计显著性的方法论要求。数学有形式化验证,证明要么编译通过要么不通过,非黑即白。物理学的标准是概率性的(5 sigma = 350万分之一误判概率),而神经网络是黑箱,无法直接输出统计置信度。Barish的原话是"物理学和AI基本上是过敏反应"。AI在物理学中目前的角色是加速工程和预警,而非参与核心科学判断。

Q3: SAIR基金会的使命和背景是什么?

SAIR由陶哲轩联合发起,使命是双向的:用AI加速科学发现,同时用科学方法约束AI。基金会诞生的时机并非巧合。一方面是AI能力的快速跃升让学术界看到了前所未有的工具机遇;另一方面,2025年美国联邦研究经费的大规模冻结暴露了公共科研资助体系的脆弱性,SAIR试图通过产业合作和慈善资金为科研建立替代性的支撑生态。这场活动本身就是SAIR的首次公开亮相。