人类能否接受AI的关心?

2025-09-12 18:25:08 · chineseheadlinenews.com · 来源: 一读EDU

在人工智能飞速发展的今天,我们频繁地接触和使用AI,由其生成的各种文本已充斥于我们的日常生活。但当我们面对那些由AI生成的“情感化回应”时,人们真的相信这些文字背后蕴含着真实的情感吗?真的觉得自己被理解了吗?尤其当一个回应被标记为“人工智能生成”而非“人类所写”,它所传递的情绪价值是否发生了变化?一篇发表在《Nature human behaviour》的文章“Comparing the values of perceived human versus AI-generated empathy”深入探讨了这一问题。Matan Rubin等人组成的研究团队开展了九项实验,总样本量为6282人,通过系统操控回应来源(标注为人类或AI),深入分析了认知、情感与动机三个维度的共情反应在人类与AI之间的评价差异。

01

问题提出与理论背景

研究者发现,目前AI已经具备了令人惊讶的社会性表现力,尤其在语言表达与情绪识别方面取得了长足进步。越来越多的企业和医疗机构尝试用AI来提供心理慰藉和社会支持,例如Replika等虚拟伴侣应用就主打“AI朋友”的情感陪伴功能。然而,共情不仅仅是语言表达的技巧,它还包含了三大核心维度:认知上的理解、情感上的共鸣以及动机上的关怀。而AI是否真正拥有这三者,尤其是“感受”和“关心”的能力,依旧存在争议。更重要的是,即使AI表现得再像人,人们是否会真正接受这份“模拟的情感”?

02

实验设计与研究流程

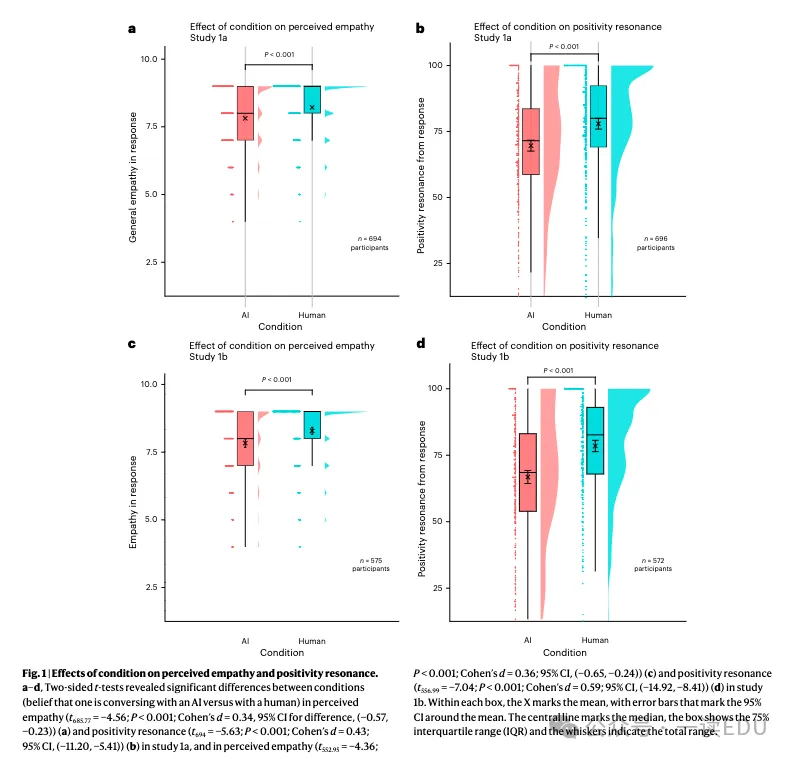

为系统探究人们对AI与人类共情回应的认知差异,研究者设计并实施了九项实验,逐步递进地验证其核心假设。实验1a至1d聚焦于检验是否存在“来源偏好”效应,也就是说,在回应内容一致的前提下,参与者是否仅因回应被标注为“人类”而赋予其更高的情感价值。在研究2a与2b中,研究者尝试控制潜在的“光环效应”——他们担心参与者可能会因为AI回应通常更迅速、语言更流畅精炼,从而误以为其共情能力更强,因此通过调整回应的语言特征与呈现方式来排除这一干扰因素。研究3,团队进一步将AI模型训练为生成三种具有代表性的回应类型,分别强调“理解”(认知共情)、“感受”(情绪共情)以及“关心”(动机共情),以此区分不同维度下AI与人类回应的效果差异。在研究4和5中,研究者引入了更贴近真实社交情境的设计:他们邀请参与者分享一段自身经历的情绪故事,并在两个回应选项中作出选择——一个是即时获得AI生成的反馈,另一个则需要等待较长时间(从2小时至2年不等),以换取一份由真实人类提供的回应。通过这一系列层层递进的实验设计,研究不仅揭示了人们对共情“来源”的显著敏感性,也为理解人类在数字化交流中对“情感真实性”的判断机制提供了重要线索。

03

研究结果

通过9个实验,研究者发现即便回应被归为人类所写,只要参与者怀疑其背后有AI的协助,也会明显降低他们对回应的情感认同。这意味着,在人们心中,真正具有情感价值的回应必须是“用心”的,是“花了时间和精力”的,而AI无论多聪明,依旧缺乏这一层“人性”。研究甚至进一步指出,当回应被限定为单轮对话、缩短为两句话,或延长等待时间时,这种偏好仍然稳定存在。这说明问题不在于AI表达得是否自然,而在于我们是否相信它“真的在乎”。

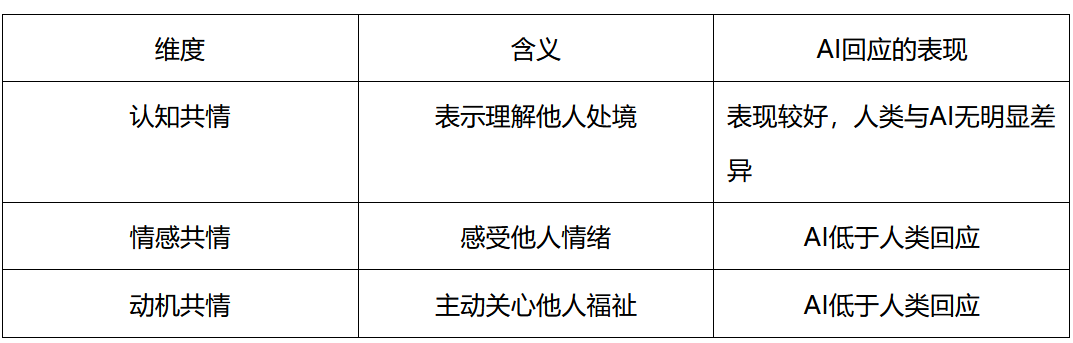

其中,在实验3中,人在认知型回应上的之,AI表现得和人一样好;但在情绪型与动机型回应中,人类则明显优于AI。这一结果提示我们:AI或许能够理解我们的情绪,但要让我们感觉到“有人和我站在一起”以及“有人真正关心我”,AI的回应仍显苍白。在实验4和5中,大部分参与者愿意等待哪怕是一周以上,只为获得一份“来自真正人类”的回应。更有意思的是,当等待的只是“被一个人读到”而非得到文字回应时,也仍然有人选择等待。

04

讨论

研究发现,即使AI和人类生成的回应内容完全一致,人们对其“感知来源”的不同会显著影响他们对共情的评价。虽然AI生成的回应被普遍认为具有一定的共情能力,但如果参与者认为回应来自人类,他们会赋予更高的价值,包括更强烈的共情感、支持感和持续交流的意愿。尤其是“情感性”和“动机性”共情(即“感同身受”与“关心他人”)的额外情感价值,只有当回应被认为来自人类时才显现。

而且在更真实的四轮对话场景中,人们仍然更看重人类回应中的情感与动机成分;而当AI仅表达“认知型共情”(即理解他人情绪)时,人类与AI回应的感知价值差异显著缩小。这表明,人们可能愿意接受AI提供的信息性理解,但对“感受”与“关怀”的期望仍然依赖于人类。虽然AI在模拟共情方面表现良好(例如高分的情感理解与支持感),但它并不具备“真正的关心”能力。在人们想要“情感分享”和“被真正关怀”的情况下,人类回应仍更具价值。AI虽能在医护、心理支持等领域提供一定帮助,但仍难以替代真正的人类连接。

其中,在研究4和5中,人们选择AI回应往往是出于“快速响应”的需求或对AI好奇;有一部分人还选择AI是为了避免被他人评判或保护隐私。而选择等待人类回应的人则更重视“被理解、被关心与被陪伴”的需求。即便只是等待人类“阅读”自己的故事,也比即时获得AI回应更有情感价值。对部分人来说,哪怕只是“被另一个人看到”这件事本身就值得等待,因为这意味着对方为他们投入了时间与情感。这种“情感投资”是AI目前无法提供的。就像收到一张没有个性化信息的贺卡,人们也会觉得缺乏真实情感——即便AI做得再好,也难以满足这种深层的情感连接需求。

05

研究局限与未来展望

值得注意的是,研究者在文中也坦率地承认了研究设计中的若干局限。首先,实验主要聚焦于短文本形式的人机交互,难以全面反映现实生活中更为复杂、持续和多模态的情感互动过程。人们在长期交流中对AI的态度、信任建立与情感连接可能与短时接触存在显著差异,因此本研究的外推性仍需进一步验证。其次,为了实现实验条件的高度可控,研究团队未设置真实人类回应组,而是统一采用AI生成的回应并操控其“来源标签”进行比较。这种设计虽然保证了变量一致性,但也可能限制了对AI与真实人类在表达共情方面差异的深入理解。最后,样本主要来源于在线平台,参与者多为习惯数字交互的网络用户,其体验和评价标准可能与线下不同人群(如老年群体、数字鸿沟下的用户)存在偏差。因此,未来的研究可进一步探索长期AI陪伴对人类心理的影响、更具拟人特征与多模态交互能力的AI共情系统,以及不同文化背景下公众对AI共情的接受与评价差异。

06

结语

随着技术的进步和人机互动的深入,人们的期待与情感边界或许也会发生转变。今天我们在意的“真实”,在未来可能会被“沉浸感”所替代。就像一个看起来足够“像人”的机器人可能在情感层面获得更高接受度一样,AI的“表演”也可能逐渐逼近人类对“情感”的要求。但无论未来如何,当前的研究都强调了一个核心事实:共情的真正价值,并不在于说了什么,而在于“谁”说的,“如何”说的,是否付出了“心意”。