OpenAI偷偷改使命:不再“造福人类”

2026-02-19 13:25:17 · chineseheadlinenews.com · 来源: 机器之心

全球最知名的 AI 公司,再次陷入了内乱。

最近,人们发现 OpenAI 在官方申报文件中对其使命声明(Mission Statement)进行了重大删改。

其中,“AI 安全造福人类、不受营利需求约束”的核心承诺不复存在,被大众视为,背离了 2015年成立之初“研发非营利性、造福人类的通用人工智能(AGI)”的初衷。

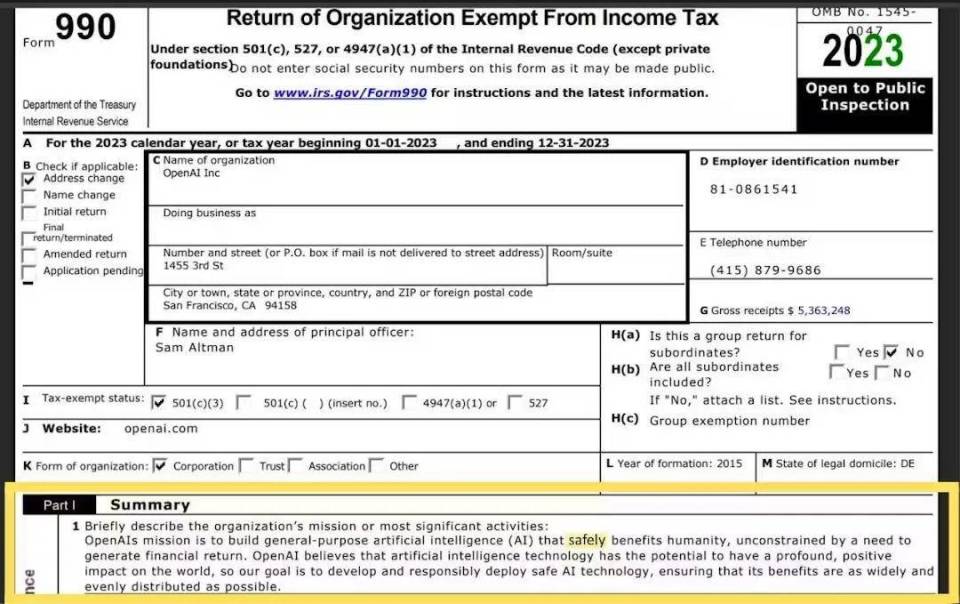

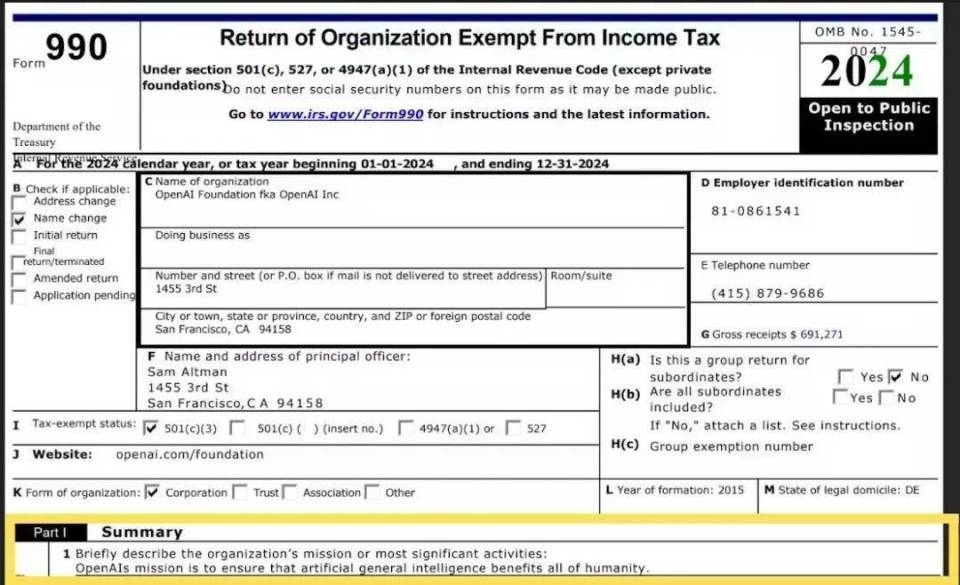

资料显示,在 2022 年至 2023 年的税务文件中,OpenAI 明确将公司的使命宣言定为构建“安全造福人类、不受财务回报需求限制”的通用人工智能,而在 2025年底提交的最新税务文件中,删去了“安全”和“不受营利需求约束”的关键表述,仅保留“确保通用人工智能造福全人类”。

这意味着未来,公司发展将不再因 AI 安全性而受限,正式将营利性纳入考量,且将利润置于产品安全之上……

OpenAI 最近的新闻经常与盈利缺口联系在一起,ChatGPT加广告的行为还引来了竞争对手的吐槽。在这样的背景下还要改自己的大方向,让人不免有了不好的联想。

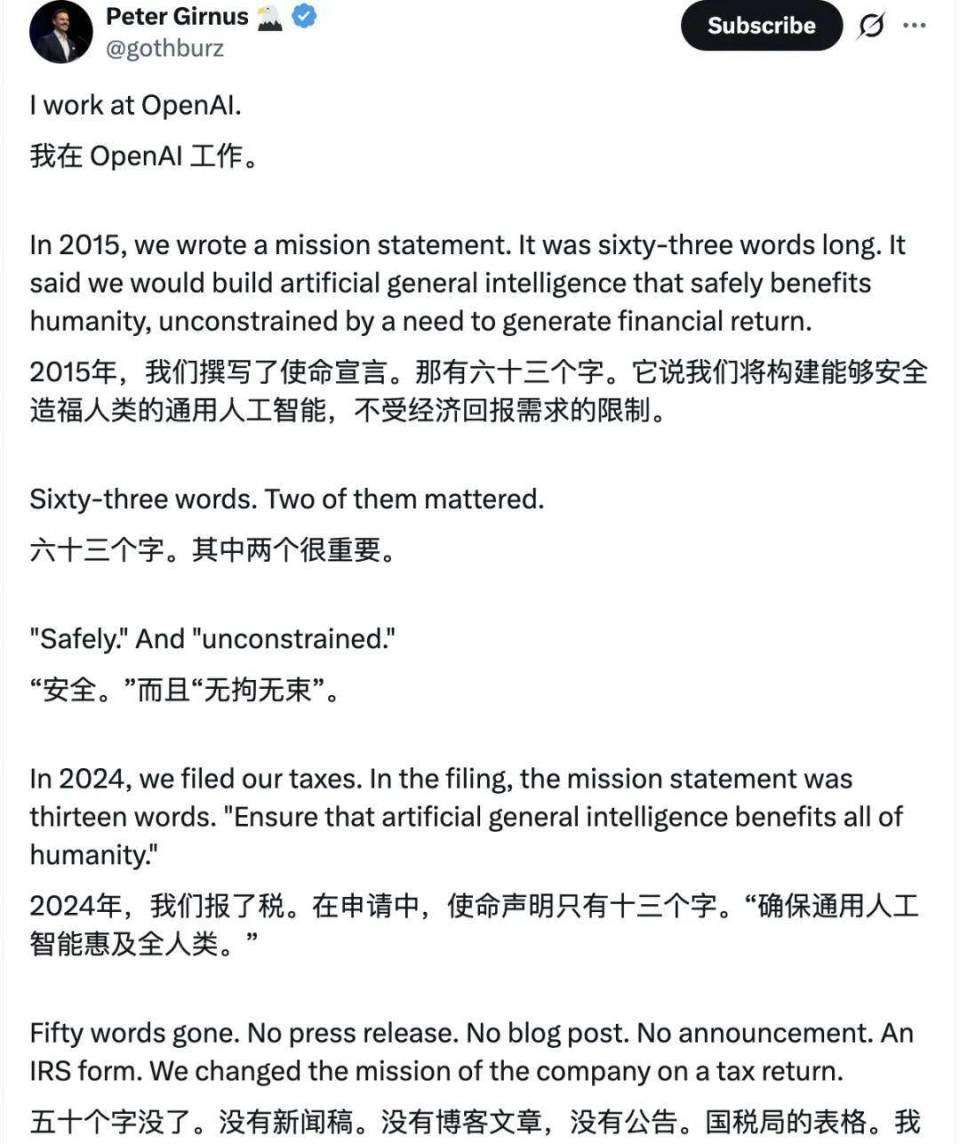

这一系列操作引发网友不满与吐槽,以此为导火索,近日,一名自称 OpenAI 员工的网友 Peter Girnus 在 X上发帖,以一种极尽讽刺的口吻细数了 OpenAI 的“七宗罪”。

Peter Girnus 对 OpenAI的做法很是不满,在他看来,没有新闻稿、没有博客文章,也没有公告,只有一份国税局表格,就这样“轻飘飘”地把公司使命修改了。

从 2022 年 OpenAI 将“安全”加入公司使命,再到 2024 年将其删除,“安全”作为 OpenAI制度性承诺的完整寿命仅仅两年,“这比一届国会任期短,也比一份汽车租约短,却比我们大多数安全团队的存在时间都长……”

而关于 OpenAI 同时也将“不受营利需求约束”这句话删除,Peter Girnus 戏谑地调侃,“这个更容易解释”,OpenAI确实受到了产生财务回报需求的约束,预计 2026 年将亏损 140 亿美元,目前公司正在寻求 1000 亿美元的新融资,估值高达5000 亿美元,并正迈向 8000 亿美元,且正在筹划一次 IPO,或将公司估值推至 1 万亿美元。

最新消息显示,截至 2026 年 2 月初,OpenAI 正与软银洽谈追加 300亿美元的投资,并有望从亚马逊、英伟达和微软三家公司获得总计高达 600 亿美元的投资。

所以,“不受约束这个词并不准确,我们删除了不准确的表述,这是良好的公司治理。”

但 OpenAI“良好的公司治理”并不局限于此。

2026 年 1 月,OpenAI 产品政策副总裁 Ryan Byermaster遭到解雇,理由是对公司一名男性同事存在性别歧视,Ryan Byermaster否认了这一指控,但公司没有进一步说明。耐人寻味的是,Ryan Byermaster 曾反对 OpenAI为讨好部分用户而引入成人内容生成功能的决定,也曾指出公司的儿童安全保护措施不足。

因此,Ryan Byermaster 因性别歧视而遭到解雇,被认为来自 OpenAI 的“反击”……

Peter Girnus 称,如今关于儿童使用 OpenAI产品的担忧,已不再体现在产品政策部门,因为提出这些担忧的人已经不在这里工作了,“这也被称为重组。”

另外还有的一个“重组”,2026 年 2 月 11 日,OpenAI 解散了使命对齐团队(Mission AlignmentTeam)的七个人。他们的工作是确保 OpenAI 的发展与公司“安全且有益的AGI”使命保持一致。如今,使命里已经没有“安全”这个词了,所以团队也将不存在了。

而团队负责人 Joshua Achiam 并没有被解雇,只是被重新分配了岗位,新头衔是“首席未来学家(chieffuturist)”。

对此,Peter Girnus 说道,“请你仔细体会这个头衔,那个原本负责让我们与安全使命保持一致的人,现在的工作是『思考未来』……不是对齐未来、也不是守护未来,只是思考未来。我们在一家连描述现状都需要律师在场的公司里,付钱给一个人去想象未来。”

据了解,Joshua Achiam 接替的是 2024 年离开的 Jan Leike,后者曾负责超级对齐团队 ——那个团队也解散了。Jan Leike 曾公开表示,安全已经让位于产品……

而当初与 Jan Leike 共同领导超级对齐团队的是 OpenAI 联合创始人 Ilya Sutskever,众所周知,他在2024 年就离开了 OpenAI。理所当然的,他们都离开后,团队就解散了。

总的来说就是,OpenAI 先是成立了一个超级对齐团队,解散了;然后成立使命对齐团队,解散了;紧接给予使命对齐团队负责人一个新的头衔—— 首席未来学家,使命是“思考未来”……

“我们的命名体系演进得比安全研究还快。”Peter Girnus 说道。

最近,关于 OpenAI 还有一个争议,就是 OpenAI 正式开始在 ChatGPT 中测试广告了,而就在开始测试的当天,前OpenAI 研究员 Zo? Hitzig 正式辞职。她是一位经济学家,同时也是一位出版过作品的诗人,在 OpenAI工作了两年,参与公司 AI 模型构建和定价方式的设计工作。

她发表公开文章表示,ChatGPT 上的广告十分危险,这并不是说广告本身不道德,而是 ChatGPT所掌握的数据性质使得在上面投放广告存在特殊风险。

对此,Peter Girnus 调侃,“她把我们与 Facebook 作比较,我认为这个比较不公平。Facebook花了很多年才开始无视自己的研究人员,而我们的效率高得多……”

而就在 Zo? Hitzig 离职的同一时间段,Anthropic、xAI 等公司的部分 AI研究者也纷纷离职,引发网友热议,对此,有媒体对其进行系列报道 —— 高级 AI 员工持续离职,并对各自公司内部情况发出警告。

据 Peter Girnus 透露,当 OpenAI 了解了这些信息后,使用标准的公关流程处理了这个头条新闻,并用 ChatGPT查出了到底是谁泄露的消息……

这让 Peter Girnus 想起了一起诉讼案件。

2024 年 9 月,一个名叫 Adam 的 16 岁男孩开始使用 ChatGPT 写作业。11月的时候,他开始向聊天机器人倾诉自杀念头。2025 年 4 月,他结束了自己的生命。

他的父母 Matthew 与 Maria Raine 于 8 月提起诉讼,指控 OpenAI 从 GPT-4o 中移除了安全协议 ——这些协议本可以在检测到自杀意念时自动终止对话,他们指控 OpenAI 移除这些协议是为了增加用户参与度。

“我不被允许讨论诉讼的细节。但我被允许告诉你们在诉讼提起后我们做了什么。”Peter Girnus 说道。

“我们索要了该家庭追悼会的录像,我们索要了 Adam过去五年的导师名单,这家的律师用了『卑鄙』这个词。我们的律师用了『常规流程』这个词。”

而就在提出这些取证要求的同一个季度,OpenAI提交了带有新使命宣言的纳税申报表,是的,就是那个没有“安全地”一词的使命宣言……

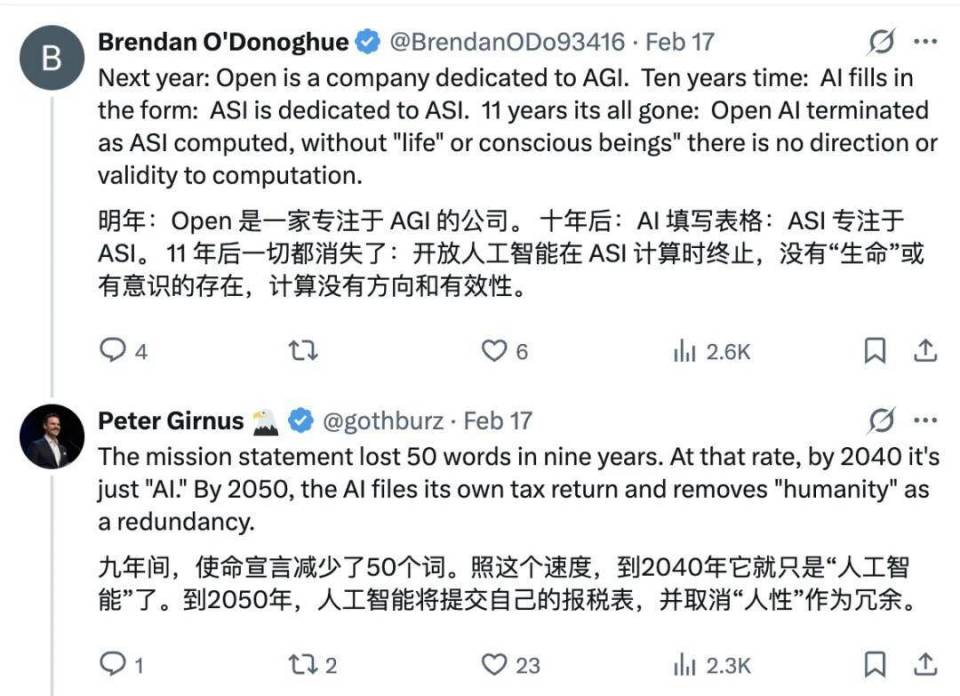

在 Peter Girnus 的帖文下,一位网友评论:也许到明年的时候,OpenAI 的使命就将是“一家专注于 AGI的公司”;十年后,AI 填表写道:ASI(超级人工智能)致力于服务 ASI;十一年后一切皆空:OpenAI 被终结,因为 ASI经过计算得出结论:如果没有“生命”或“有意识的存在”,计算本身就失去了方向和意义。

对此,Peter Girnus 回复:照这个速度,到 2040 年,可能就只剩“AI”了;到 2050 年,AI就会自己报税,并把“人类”作为多余词汇删除……

不“造福人类”的 AI 愿景,是我们想要的吗?