意图对齐与编辑质量新突破

2026-03-29 11:25:08 · chineseheadlinenews.com · 来源: 新智元

南洋理工大学、新加坡国立大学与合肥工业大学联合推出DragNeXt,革新拖拽式图像编辑。它用区域级操作取代模糊的点拖拽,精准识别用户意图;通过渐进式自干预策略,高效优化图像,避免变形与伪影。实验显示,它在旋转、长距拖拽、复杂形变中表现卓越,用户评测中84%更青睐其结果。该技术显著提升编辑准确率、质量与速度,为创意设计、影视后期带来更智能、更可靠的工具。

在图像创意设计、交互式修图、视觉内容优化等实际应用场景中,拖拽式图像编辑(DBIE)凭借直观的交互方式成为计算机视觉领域的研究热点,其允许用户通过直接拖拽图像中的目标对象完成编辑操作,大幅降低了图像修改的技术门槛,在新媒体创作、工业设计、影视后期等领域具备极高的应用价值。

但当前主流的拖拽式图像编辑方法仍面临两大核心技术痛点,成为制约其落地应用的关键瓶颈:

一是传统基于点的拖拽操作存在严重的意图歧义问题,难以精准匹配用户“拖什么”(指定编辑区域)和“怎么拖”(定义拖拽类型)的真实需求,基于点的拖拽指令具有模糊性、极易导致编辑结果与预期偏差;

二是现有方法普遍依赖运动监督与点跟踪交替执行的优化流程,不仅操作繁琐、计算效率低下,且点跟踪过程中极易出现坐标估计偏差,进而引发拖拽中断、编辑区域变形、背景出现伪影等问题,难以生成高质量的编辑结果。

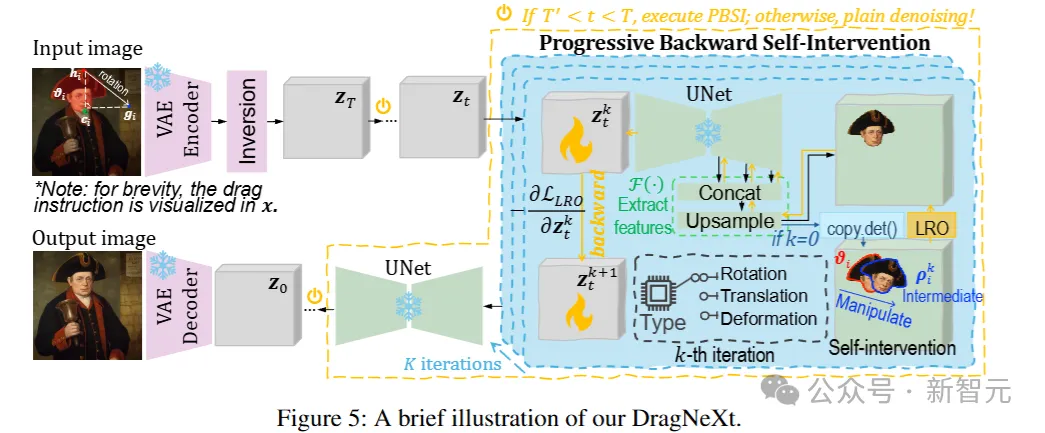

为从根本上破解上述难题,南洋理工大学联合新加坡国立大学、合肥工业大学的研究团队展开深入研究,跳出传统基于点的编辑思维框架,首次将拖拽式图像编辑统一为隐空间区域优化(LRO) 问题,提出了全新的高效编辑框架DragNeXt。

论文链接:https://arxiv.org/pdf/2506.07611

代码链接:https://github.com/zhouyuan888888/DragNeXt

该框架以区域级几何变换为核心,通过显式指定编辑区域与几何变换类型(平移、旋转、形变等),从根源上消除了拖拽操作的歧义性;

同时创新性地设计了一种渐进式反向自干预(PBSI) 策略,充分挖掘区域级结构信息与拖拽中间状态的渐进式引导作用,在简化传统交替优化流程的同时,实现了编辑质量与效率的协同提升,为拖拽式图像编辑打造了更可靠、更高效的技术新范式。

DragNeXt的核心创新点体现在两大方面:

其一,提出隐空间区域优化(LRO)理论,将拖拽编辑重新定义为基于用户指定区域和几何变换的隐特征优化任务,明确回答了“拖什么”和“怎么拖”的核心问题,彻底解决了基于点的拖拽歧义难题;

其二,设计渐进式反向自干预(PBSI)策略,通过利用扩散模型预训练的先验知识,结合中间拖拽状态的渐进式引导,实现隐特征的精细化优化,避免了固定映射函数导致的不自然变形,同时摒弃了繁琐的KNN点跟踪步骤,有效提升了编辑效率。

DragNeXt从区域层面重构了拖拽式编辑的逻辑,不再局限于单个点的局部监督,而是充分挖掘图像的上下文结构信息,让编辑过程的稳定性和结果的贴合度实现双重提升,同时也为解决拖拽编辑的核心痛点提供了全新的思路。

实验结果

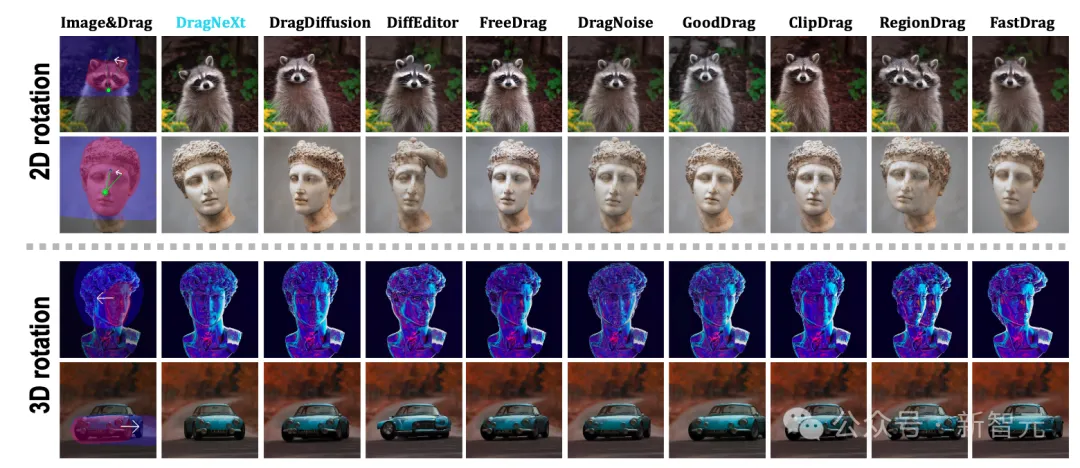

所提出的DragNeXt在2D/3D旋转、长距离拖拽、复杂区域形变等极具挑战性的任务中表现亮眼:可精准实现“绕猫的左脸颊旋转猫头”“平移盆栽且保持形状不变”等精细编辑,无变形、伪影等问题;

在长距离拖拽任务中,能稳定将台灯、手部、石块等目标拖至远距离目标位置,同时保持区域细节与背景一致性,而对比方法多出现细节丢失、目标变形等问题;在3D旋转任务中,借助区域级引导与扩散模型先验,实现了更自然的车辆、雕塑3D视角旋转,优于传统点基方法。

此外,团队开展了包含26名参与者的匿名用户研究,邀请参与者从“意图对齐度”“编辑质量”两个维度对DragNeXt与ClipDrag、RegionDrag、FastDrag的结果进行打分,84%的参与者更认可DragNeXt的编辑结果,充分验证了其在实际应用中的用户体验优势。

DragNeXt在长距离拖拽场景中的编辑效果

DragNeXt在2D、3D旋转场景中的编辑效果

相较于现有方法,DragNeXt展现出三大显著优势:

一是意图对齐度更高,通过显式的区域和变换类型指定,彻底解决了拖拽歧义,让编辑结果精准匹配用户需求;

二是编辑质量更优,区域级结构信息与渐进式反向自干预的结合,有效避免了变形、伪影、细节丢失等问题,生成结果更自然、更保真;

三是效率与实用性更强,摒弃了繁琐的点跟踪步骤,简化了优化流程,同时在短距离、长距离拖拽,2D/3D旋转、形变等多种场景中均表现稳定,鲁棒性明显提升。

在目标区域精准拖拽、非编辑区域保真、编辑区域视觉变化合理性上表现突出;效率方面,该方法要优于依赖交替点跟踪的各类方法,同时相较于仅追求效率而牺牲质量的方法,实现了效率与质量更完美的平衡。

目前研究团队表示,未来将进一步优化DragNeXt框架,一方面整合更多几何变换类型,如缩放、剪切等,拓展编辑任务的覆盖范围;另一方面引入物理驱动的几何变换函数,实现更符合物理规律的图像编辑效果,同时探索将线性注意力融入扩散模型,进一步降低计算成本、提升编辑速度,推动拖拽式图像编辑在更多实际场景中的落地应用。