博通27年AI芯片营收将破1000亿

2026-03-04 21:25:37 · chineseheadlinenews.com · 来源: 华尔街日报

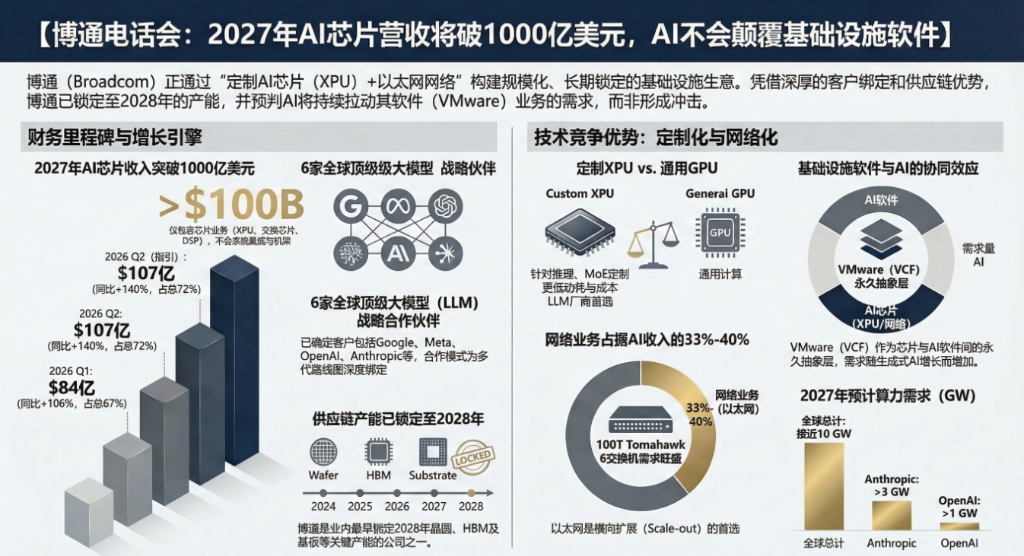

博通在电话会中预计到2027年,仅来自AI芯片的营收就将远超1000亿美元,总出货量将接近10吉瓦。博通认为,作为人工智能软件和物理芯片(硅)之间的永久抽象层,VCF等基础设施软件不可被取代或替代。依托与客户深度的多年期合作,博通已经提前锁定了2026年至2028年的关键组件产能,成为了业内最早锁定2028年产能的公司之一。

受AI芯片业务翻倍增长的强力引擎驱动,博通2026财年第一季度营收创下历史新高,并预计在2027年实现AI芯片收入突破1000亿美元的惊人里程碑。

随着全球生成式AI竞赛进入白热化,底层算力基础设施的头号玩家正在交出远超市场预期的答卷。博通在随后的2026财年第一季度财报电话会议上抛出了一个宏大的指引:“我们现在有信心在2027年实现仅芯片业务的AI收入超过1000亿美元。”

整体来看,博通正在把“AI 定制芯片+以太网网络”做成一个规模化、可复制、长期锁定的基础设施生意,并且已经提前锁定到 2028 年。以下是电话会要点:

2027年AI芯片收入>1000亿美元,6家长期战略客户

HockTan在本次电话会上做了极具冲击力的指引:2027年,仅芯片(XPU+交换芯片+DSP)AI收入将超过1000亿美元,注意几个关键点:仅芯片、不含机架、不含系统集成。

分析师追问后他确认,2027年预计接近10吉瓦装机容量。而按照行业单吉瓦价值推算:1吉瓦≈200亿美元左右内容价值。这意味着:10吉瓦≈2000亿美元潜在规模,博通取其中一部分,>1000亿并不夸张。

这是本次电话会的另一核心变化——客户数量首次明确为6家。已公开或可推断客户包括:Google(TPU)、Meta(MTIA)、OpenAI、Anthropic、另外两家未公开LLM平台客户。其中,Anthropic对TPU计算能力的需求预计将在2027年激增至超过3吉瓦,而OpenAI也将在同年大规模部署超过1吉瓦的算力。

关键的是,全部是LLM平台级公司,并且都在构建自己的定制XPU,而且都是多代路线图合作,合作2–4年滚动规划。管理层强调这不是短期交易,而是多代战略绑定。

XPU或将持续侵蚀GPU

Hock在Q&A里表达得非常明确:GPU是通用密集矩阵乘法架构,XPU可针对MoE、推理、预填充、解码等负载定制。

随着模型演进,定制化的XPU最终将成为客户的首选,因为它允许为特定的工作负载量身定制架构,提供更低的成本和功耗。

博通观察到,技术成熟的客户正在走向每年同时开发两款专用芯片的路线——一款专门用于模型训练,另一款专门针对推理进行产品化。

这意味着定制芯片的需求不是一次性替代GPU,而是长期双线扩张。

网络是被严重低估的增长引擎

Q3问答中,管理层大幅强调网络。当前结构AI收入中,网络占比Q1为33%,Q2预计将达到40%,未来预计区间长期33%–40%

网络增长逻辑来自两个层面:

在横向扩展(Scale-out)方面:以太网是首选方案。博通率先上市的100Tbps Tomahawk 6交换机面临着巨大的市场需求,公司计划在2027年推出性能翻倍的Tomahawk 7。

在纵向扩展(Scale-up)方面:在机架内的集群域中,应该尽可能长时间地使用直接附加铜缆(DAC)来直接连接XPU或GPU,因为与光学方案相比,铜缆具有最低的延迟、最低的功耗和成本优势。目前博通的技术已经能通过铜缆驱动400G的传输速率。

这意味着博通在交换芯片、DSP、以太网scale-up,三个维度同时获益。

供应链产能已锁定至2028年

依托与客户深度的多年期合作,博通已经提前锁定了2026年至2028年的关键组件产能(包括前沿晶圆、高带宽内存、基板等),成为了业内最早锁定2028年产能的公司之一。

在被问及为何能把供应判断延伸到2028年时,Tan说:“我们很早就掌握了光罩的锁定技术……那我们绝对是最早一批掌握这项技术的。”并称这得益于“早期的预期”与“非常优秀的合作伙伴”。

半导体解决方案事业部总裁Charlie Kawwas则补充,客户会分享未来2-4年的预期,促使公司提前锁定产能与技术投入。分析师追问“以目前的供应情况来看,2028年你能实现增长吗?”Kawwas回答:“是的。”

备货端,CFO Kirsten Spears披露:“由于我们持续采购零部件以满足强劲的人工智能需求,第一季度末库存为30亿美元。”库存周转天数升至68天(上一季度为58天),并指出主要原因是“我们预期人工智能半导体业务将加速增长”。

基础设施软件不会被AI替代,反而受益

除硬件外,博通也在电话会上强调软件业务的“确定性”。

Tan表示:“我们基础设施软件不会受到人工智能的冲击。”他称VMware云基础架构(VCF)是数据中心“核心软件层”,并强调其长期价值:“作为人工智能软件和物理芯片(硅)之间的永久抽象层,VCF不可被取代或替代。”

公司披露,第一财季VMware收入同比增长13%,基础设施软件“订单量持续强劲,第一季度合同总额超过92亿美元”,年度经常性收入(ARR)同比增长19%。Tan进一步称:“我们相信,生成式人工智能和智能体人工智能的增长将会增加对VMware的需求,而不是减少。”

以下是2026年第一季度财报电话会议原文

操作员:

欢迎参加博通公司 2026 财年第一季度财务业绩电话会议。现在,我将把电话交给博通公司投资者关系主管 Ji Yoo 先生,请他致开幕词并进行介绍。

投资者关系负责人 Ji Yoo:

谢谢接线员,大家下午好。今天参加电话会议的有:总裁兼首席执行官 Hock Tan、首席财务官 Kirsten Spears、半导体解决方案事业部总裁 Charlie Kawwas 以及基础设施软件事业部总裁 Ram Velaga。博通在收盘后发布了新闻稿和财务报表,介绍了我们 2026 财年第一季度的财务业绩。如果您没有收到,可以从博通官网 broadcom.com 的“投资者关系”栏目获取相关信息。本次电话会议正在进行网络直播,您也可以通过博通官网“投资者关系”栏目收听为期一年的录音回放。在准备好的发言环节,Hock 和 Kirsten 将详细介绍我们 2026 财年第一季度的业绩、对 2026 财年第二季度的业绩展望,以及对当前商业环境的评论。发言结束后,我们将回答各位的问题。请参阅我们今天发布的新闻稿以及我们近期向美国证券交易委员会提交的文件,了解可能导致我们实际业绩与本次电话会议中作出的前瞻性陈述存在重大差异的具体风险因素。除美国通用会计准则(GAAP)报告外,博通还以非 GAAP 准则报告某些财务指标。GAAP 和非 GAAP 指标的调节表包含在今天新闻稿的附件表格中。今天电话会议中的发言将主要涉及我们的非 GAAP 财务业绩。现在我将把电话会议交给霍克先生。

总裁兼首席执行官 Hock E. Tan:

谢谢 Ji,也感谢各位今天莅临。在 2026 财年第一季度,我们的总营收达到创纪录的 193 亿美元,同比增长 29%,超出预期,这主要得益于人工智能半导体业务超出预期的增长。强劲的营收增长转化为卓越的盈利能力,第一季度合并调整后 EBITDA 达到创纪录的 131 亿美元,占营收的 68%。这些数据表明,我们的规模优势持续推动着显著的运营杠杆效应。

我们预计,随着我们定制的 AI XPU 在五家客户中进入下一阶段的部署,这一增长势头将加速。展望 2026 年第二季度,我们预计合并营收约为 220 亿美元,同比增长 47%。

现在让我更详细地介绍一下我们的半导体业务。第一季度,营收创下 125 亿美元的新纪录,同比增长 52%。这一强劲增长主要得益于人工智能半导体营收的强劲增长,该业务同比增长 106%至 84 亿美元,远超我们的预期。第二季度,这一增长势头将进一步增强,我们预计半导体营收将达到 148 亿美元,同比增长 76%。推动这一增长的主要动力是人工智能营收,该业务的营收将大幅增长,同比增长 140%至 107 亿美元。

我们的客户加速器业务在第一季度同比增长了 140%,这一增长势头在第二季度得以延续。我们所有五家客户的定制 AI 加速器内存使用情况都进展顺利。对于谷歌而言,由于对第七代 Ironwood TPU 的强劲需求,我们在 2026 年继续保持增长势头。我们预计,在 2027 年及以后,下一代 TPU 的需求将更加强劲。

就装机规模计算而言,我们在 2026 年取得了非常好的开端,预计 TPU 计算能力将达到 1 吉瓦。而到了 2027 年,这一需求预计将超过 3 吉瓦。最后,我想说的是,我们的 XPU 产品线远不止 TPU。与近期分析师的报告相反,Meta 的定制加速器 MTIA 路线图仍在稳步推进。我们现在已经开始发货。事实上,对于下一代 XPU,我们将在 2027 年及以后将其计算能力扩展到数吉瓦。再说说第四和第五位客户,我们预计今年的出货量将非常强劲,并且预计 2027 年将翻一番以上。我们现在还有第六位客户。我们预计 OpenAI 将在 2027 年大规模部署其第一代 XPU,计算能力将超过 1 吉瓦。

我想借此机会强调一下,我们与这六家客户在开发 AI XPU 方面的合作是深入、战略性且为期多年的。我们为每家合作伙伴带来了在芯片设计、工艺技术、先进封装和网络方面无与伦比的技术,从而帮助每位客户针对其差异化的 LLM 工作负载实现最佳性能。我们拥有丰富的经验,能够以极高的良率快速交付这些 XPU,并实现大批量生产。除了技术优势之外,我们还提供多年供货协议,以支持客户扩展其计算基础设施的部署规模。

在当前尖端晶圆、高带宽存储器和衬底产能受限的情况下,我们仍能确保供应,从而保障合作伙伴关系的持久性。我们已完全确保 2026 年至 2028 年这些组件的产能。与我们 XPU 的强劲前景相一致,人工智能网络的需求也呈现蓬勃发展的态势。第一季度人工智能网络收入同比增长 60%,占人工智能总收入的三分之一。我们预计第二季度人工智能网络业务将加速增长,占人工智能总收入的 40%。我们在网络领域的市场份额正在显著提升。

让我解释一下。在横向扩展方面,我们首款上市的 Tomahawk 6 交换机(吞吐量达 100 Tbps)以及 200G 30 系列交换机正迅速满足超大规模数据中心的需求,无论他们今年使用的是 XPU 还是 GPU。到 2027 年,随着性能翻倍的下一代 Tomahawk 7 的推出,这一领先优势将进一步扩大。同时,在纵向扩展方面,随着集群规模和客户数量的增长,我们凭借 200G 解决方案,能够帮助这些客户继续使用直连铜缆。随着我们在 2028 年将解决方案升级到 400G,我们的 XPU 客户很可能仍将继续使用直连铜缆。这是一个巨大的优势,因为采用光纤方案成本更高,而且需要消耗更多的电力。

鉴于上述因素,我们对 2027 年的前景预期已显著提升。事实上,我们现在有信心在 2027 年实现仅芯片业务的 AI 收入超过 1000 亿美元。我们也已确保了实现这一目标所需的供应链。接下来谈谈非 AI 半导体业务。第一季度收入为 41 亿美元,与去年同期持平,符合预期。企业网络宽带服务存储收入同比增长,但被无线业务的季节性下滑所抵消。我们预计第二季度非 AI 半导体收入约为 41 亿美元,同比增长 4%。现在让我谈谈我们的基础设施软件业务。第一季度基础设施软件收入为 68 亿美元,符合预期,同比增长 1%。我们预计第二季度基础设施软件收入约为 72 亿美元,同比增长 9%。VMware 收入同比增长 13%。订单量持续强劲,第一季度合同总额超过 92 亿美元,年度经常性收入 (ARR) 同比增长 19%。我要强调的是,我们基础设施软件业务的增长体现了我们对基础架构的重视和投入。而且,我们的基础设施软件不会受到人工智能的冲击。事实上,VMware 云基础架构 (VCF) 是数据中心的核心软件层,它将 CPU、GPU、存储和网络集成到一个通用的高性能私有云环境中。作为人工智能软件和物理芯片(硅)之间的永久抽象层,VCF 不可被取代或替代。它使企业能够以硬件无法企及的敏捷性高效扩展复杂的生成式人工智能工作负载。 我们相信,生成式人工智能和智能体人工智能的增长将会增加对 VMware 的需求,而不是减少。总而言之,让我总结一下 2026 年第二季度的情况,我们预计合并收入同比增长将加速至 47%,达到约 220 亿美元。 我们预计调整后 EBITDA 将约为营收的 68%。因此,让我把电话转给克尔斯滕。

首席财务官兼首席会计官克尔斯滕·斯皮尔斯:谢谢霍克。现在让我详细介绍一下我们第一季度的财务业绩。本季度合并营收创历史新高,达到 193 亿美元,同比增长 29%。毛利率为 77%。合并运营支出为 20 亿美元,其中研发支出为 15 亿美元。第一季度营业利润创历史新高,达到 128 亿美元,同比增长 31%。得益于有利的运营杠杆,营业利润率同比增长 50 个基点,达到 66.4%。调整后 EBITDA 为 131 亿美元,占营收的 68%,高于我们此前 67%的预期。

现在我们来详细了解一下两个业务板块。首先是半导体业务。半导体解决方案业务板块的营收创下 125 亿美元的新高,同比增长 52%,主要得益于人工智能的强劲增长。半导体业务营收占本季度总营收的 65%。半导体解决方案业务板块的毛利率同比增长 30 个基点,达到约 68%。11 亿美元的运营支出反映了对领先的边缘人工智能半导体研发投入的增加,占营收的 8%。半导体业务的运营利润率为 60%,同比增长 260 个基点,体现了强劲的运营杠杆效应。

接下来是基础设施软件部分。基础设施软件收入为 68 亿美元,同比增长 1%,占总收入的 35%。本季度基础设施软件的毛利率为 93%,运营费用为 9.79 亿美元。第一季度软件运营利润率同比增长 190 个基点,达到 78%。

接下来是现金流情况。本季度自由现金流为 80 亿美元,占营收的 41%。我们在资本支出方面投入了 2.5 亿美元。由于我们持续采购零部件以满足强劲的人工智能需求,第一季度末库存为 30 亿美元。第一季度库存周转天数为 68 天,而第四季度为 58 天,这主要是由于我们预期人工智能半导体业务将加速增长。

关于资本配置。第一季度,我们向股东派发了 31 亿美元的现金股息,每股普通股现金股息为 0.65 美元。当季,我们回购了价值 78 亿美元(约 2300 万股)的普通股。第一季度,我们通过股息和股票回购共向股东返还了 109 亿美元。第二季度,我们预计不计潜在股票回购的影响,非 GAAP 稀释后股份数量约为 49.4 亿股。第一季度末,我们持有现金 142 亿美元。今天,我们宣布董事会已批准追加 100 亿美元用于股票回购计划,该计划有效期至 2026 年底。

接下来是业绩展望。我们预计第二季度合并营收为 220 亿美元,同比增长 47%。其中,半导体业务营收预计约为 148 亿美元,同比增长 76%。我们预计第二季度人工智能半导体业务营收为 107 亿美元,同比增长约 140%。基础设施软件业务营收预计约为 72 亿美元,同比增长 9%。为方便您进行模型构建,我们预计第二季度合并毛利率将与上一季度持平,为 77%。我们预计第二季度调整后 EBITDA 约为 68%。

我们预计,受全球最低税的影响以及与 2025 财年相比收入地域构成的变化,2026 财年第二季度的非 GAAP 税率约为 16.5%。我的发言到此结束。接线员,请开始提问环节。

以下是分析师问答:

操作员:

谢谢。(操作员说明)我们第一个问题来自杰富瑞集团的布莱恩·柯蒂斯。您的线路已接通。

Q1 分析师布莱恩·柯蒂斯:您好,下午好,感谢您回答我的问题。我先问一个问题,然后再问一个需要澄清的问题。霍克,关于超过 1000 亿美元的营收,我想您指的是人工智能芯片。我只是想确认一下您解释的是 ASIC 芯片和网络芯片之间的区别,以及营收是如何体现在这两方面的。然后是另一个问题,我认为目前贵公司面临的最大挑战是人工智能业务在本季度增长了近一倍。我认为这就是今年云计算资本支出增长的主要趋势。我很好奇您的看法,鉴于您对 2027 年的展望,我认为贵公司应该会取得不错的业绩。我还想了解一下,投资者普遍认为超大规模云服务商需要在今年、明年甚至后年才能获得投资回报,您对此有何看法?您是如何将这种悲观情绪纳入您的展望中的?

总裁兼首席执行官 Hock E. Tan:

我们看到——过去几个月以来,我们一直看到,而且这种趋势还在持续——这其实并非主要指超大规模数据中心,我们的客户群体仅限于少数几家公司,其中一些是超大规模数据中心,一些则不是,但他们都有一个共同点,那就是创建大语言模型(LLM),将其产品化并构建平台,无论是面向企业的代码辅助、智能体人工智能,还是面向消费者的订阅服务。我们了解到,这些公司中,少数潜在客户,以及我们现在的许多客户,都在创建这种通用平台——无论是生成式人工智能还是智能体人工智能。这些就是我们的客户,而且我们看到,他们对计算能力的需求越来越强。训练是他们持续需要的,但真正让我们感到惊讶的是,推理能力的需求也非常强劲,以便将他们最新创建的生命周期模型产品化并实现盈利。这种推理正在推动大量的计算能力增长,这对我们来说是件好事,因为我们的这五六家客户正在着手打造他们自己的定制加速器。不仅如此,他们还在设计这些客户加速器的网络集群架构。所以我认为,正如过去六个月我们听到的消息一样,需求将会持续增长。 现在,布莱恩,为了澄清你的第一部分,当我说我们预测,我们有理由相信我们在 2027 年的收入将大幅超过 1000 亿美元时,我强调的是,这些收入几乎全部基于芯片,无论是 XPU、交换芯片还是 DSP,我们谈论的都是硅芯片。

分析师布莱恩·柯蒂斯:非常感谢。

操作员:稍等片刻,我们进入下一个问题。这个问题将由摩根大通的哈兰·苏尔先生提出。您的电话已接通。

Q2 分析师哈兰·苏尔:下午好。感谢您回答我的问题,也祝贺团队取得了如此优异的成绩。Hock,最近关于云服务提供商 (CSP) 和超大规模数据中心运营商开展内部 XPU 和 TPU 设计工作的消息很多,对吧?我们称之为 COT,即客户自有工具。这在 ASIC 领域并非新鲜事,对吧?我认为博通团队在过去 30 多年里也经历过这种 COT 竞争格局,对吧?你们一直是 ASIC 行业的领导者,但这些 COT 项目鲜有成功的。

现在谈到人工智能,一些 COT 项目已经上市,但它们的性能似乎至少比你们目前的解决方案低一半,芯片设计复杂度、封装复杂度和 IP 复杂度也低一半。所以,我可能要问两个问题。Hock,第一个问题是,鉴于你对明年的预测,你认为 COT” 项目能否从博通手中夺走任何有意义的 TPU XPU 市场份额?第二个问题是,从性能、复杂度和 IP 的角度来看,博通的 TPU XPU 项目比任何 COT 项目都领先 12 到 18 个月,博通团队将如何进一步扩大这一差距?

总裁兼首席执行官 Hock E. Tan:

嗯,这是一个很好的问题。而且,正如我在开场白中特意提到的,当任何一家超大规模数据中心或 LLM开发商试图完全自主地创建所谓的客户自有工具(COT)模型时,他们都会面临巨大的挑战。其中之一是技术,也就是与制造硅芯片相关的技术,特别是用于计算的 XPU(扩展处理器),以及优化和运行 LLM 工作负载所需的训练和推理所需的技术。我们刚才提到的技术来自不同的层面。你需要最优秀的芯片设计团队。你需要尖端的、真正尖端的 C30 芯片,非常先进的封装技术,而且同样重要的是,你需要了解如何将这些芯片集群连接起来。我们从事这行已经超过 20 年了,在硅芯片领域,尤其是在生成式人工智能这个特定领域,如果你作为一家 LLM厂商想要自主研发芯片,就不能只满足于“够用”的芯片。你需要市面上最好的芯片,因为你要和其他 LLM 厂商竞争。最重要的是,你还要和英伟达竞争,他们丝毫没有放松警惕。他们每一代都在不断推出性能更优的芯片。

所以,作为一家 LLM 公司,如果你想在世界范围内建立自己的平台,就必须制造出比现有芯片更优秀的芯片,不仅要与 NVIDIA 竞争,还要与所有其他平台厂商竞争。为此,你确实需要我们的信任,我们首先看到的是这一点,以及拥有业内最佳技术、知识产权和执行力的硅芯片合作伙伴。非常谦虚地说,我们遥遥领先,在未来很多年内,COT 领域都不会出现竞争对手。竞争终究会到来,但我们还有很长的路要走,因为这场竞争仍在继续。

还有一点是我们独有的:当你制造出硅芯片时,你必须迅速将其投入大规模量产,尽快推向市场。我们在这方面经验非常丰富。任何人都能在实验室里设计出一款性能良好的芯片。但你能以可承受的良率快速生产出 10 万颗这样的芯片吗?我们很少看到世界上有哪家公司能做到这一点。查理?

分析师哈兰·苏尔:谢谢。谢谢你,查理。

操作员:

稍等片刻,我们进入下一个问题。这个问题将由德意志银行的罗斯·西摩提出。您的电话已接通。

Q3 分析师罗斯·西摩:

您好,感谢您帮我提问。霍克,在您的演讲稿中,您比以往更侧重于网络方面的差异化优势。所以我想问一个短期和一个长期的问题。短期问题是,是什么因素推动网络业务在人工智能收入中占比高达 40%?长期问题是,这个比例——也就是在超过 1000 亿美元的收入中——是否会发生变化?您预计在该业务领域保持怎样的领先地位,是横向扩展还是纵向扩展?您在该领域的领先地位是否有助于您的 XPU 业务,因为您可以同时优化计算和网络方面?

总裁兼首席执行官 Hock E. Tan:

好的,我们先来回答第一个问题。罗斯,这个问题相当复杂。是的,在网络方面,尤其是在新一代 GPU 和 XPU 即将推出的时候,我们的带宽已经达到了 200Gbps 甚至千兆比特。我们大约在六个月前(确切地说是九个月前)推出的 Tomahawk 6,是目前市场上唯一一款。我们的客户和超大规模数据中心运营商都希望他们的集群能够使用最好的网络和最高的带宽。

所以我们看到对这方面的需求非常巨大——目前市面上只有一台 100Tbps 的交换机。这极大地推动了需求。再加上我们以 1.6 倍带宽运行 Ben,用于扩展光收发器带宽。我们再次成为市场上唯一一家以 1.6 倍带宽运行 DSP 的厂商。我认为,这些因素共同推动了我们网络组件的增长,甚至超过了我们 XPU 的增长速度,而 XPU 的增长速度已经相当惊人了。这就是你现在看到的。但我认为,在某个时候,这些需求会趋于稳定,尽管我们不会放慢速度,因为正如我所说,明年,也就是 2027 年,我们将推出下一代 Tomahawk 7,性能是现在的两倍,我们很可能成为首批推出该产品的厂商,这将继续保持增长势头。最后,回答你的问题,是的,我预计在任何季度,AI 网络组件在我们总 AI 收入中的占比都将在 33%到 40%之间。

分析师罗斯·西摩:太好了,谢谢霍克。

总裁兼首席执行官 Hock E. Tan:谢谢。

操作员:

稍等片刻,我们进入下一个问题。这个问题将出自 CJ Muse 与 Cantor Fitzgerald 的对话。您的对话已开启。

Q4 分析师 CJ Muse:下午好。感谢您回答这个问题。我很好奇,您如何看待将预填充和解码从 GPU 生态系统中分离出来,以及这对定制芯片需求的影响?您是否预见到 GPU 和定制芯片之间的相对比例会发生任何变化?

总裁兼首席执行官 Hock E. Tan:

CJ,我不太明白你的问题,你能解释一下“分解”是什么意思吗?

分析师 CJ Muse:

当然,将工作负载推给 CPX 进行预填充,并按解码次数进行处理,你知道,这种分散化的环境是否会对定制需求与采用完整的 GPU 堆栈的需求造成任何压力。

总裁兼首席执行官 Hock E. Tan:

好的,我明白你的意思了。这种聚合方式,某种程度上来说,你真正想表达的是——人工智能加速器的架构,无论是 GPU 还是 XPU,是如何随着工作负载的演变而演进的。而这正是我们目前非常关注的。通用 GPU 虽然可以满足所有需求,但它也只能做到这一步。它仍然可以继续运行,因为你仍然可以运行不同的工作负载,比如运行混合专家模型,即使你希望确保专家模型具有稀疏成本才能非常有效(你听说过这个术语)。但在 GPU 中,它是为密集矩阵乘法而设计的。

所以,虽然可以用软件内核来实现,但这不如在芯片上实现高效,而且 XPU 的设计初衷就是为了在混合专家工作负载方面拥有更高的性能。推理也是如此。最终,你会发现 XPU 的设计越来越针对我们 LLM 客户的特定工作负载进行定制。而且,这种设计开始依赖于传统的标准 GPU 设计,这也是为什么我们之前一直强调的,XPU 最终会成为更佳选择,因为它能够灵活地设计出适用于特定工作负载的模型,例如一个用于训练,一个用于推理。

正如您所说,一个可能更擅长预填充,另一个可能更擅长训练后、强化学习或测试时间扩展。您可以调整 TPU,使其更适合 XPU,或者更准确地说,是针对您想要的特定工作负载 LLM 进行调整。我们已经看到了这一点。我们在所有五位客户身上都看到了这种趋势。

操作员:

稍等片刻,我们进入下一个问题。这个问题将由瑞银集团的蒂莫西·阿库里先生提出。您的电话已接通。

Q5 分析师 Timothy Arcuri:

非常感谢。我有个关于这些机架系统发货后毛利率波动的问题。我的意思是,很明显,发运这些机架会拉低综合毛利率,但我想知道您能否提供一些参考标准?该产品的毛利率似乎在 45% 到 50% 之间。所以我想,随着机架开始发货,我们是否应该考虑到毛利率会下降大约 500 个基点?另外,Hock,是否存在一个毛利率下限,低于这个下限您就不会继续生产更多机架了?谢谢。

总裁兼首席执行官 Hock E. Tan:

很遗憾地告诉你,你可能有点幻觉了。我们的毛利率确实和克尔斯滕报告的数字一样。毛利率的波动以及人工智能产品价格上涨都不会影响到我们。我们的良率和成本都已经控制在合理范围内,人工智能领域的模型将与我们半导体业务其他领域的模型基本一致。克尔斯滕?

首席财务官兼首席会计官克尔斯滕·斯皮尔斯:我同意这个观点。我认为,经过进一步研究,即使与我上个季度发表的评论相比,对我们整体业务结构的影响实际上也微乎其微。所以,我并不担心。

分析师 Timothy Arcuri:好的,非常感谢。

操作员:

稍等片刻,我们进入下一个问题。这个问题将由伯恩斯坦的斯泰西·拉斯贡提出。您的线路已接通。

Q6 分析师 Stacy Rasgon:

大家好。感谢你们回答我的问题。我不知道这个问题应该问 Hock 还是 Kirsten,但我很想深入了解一下明年超过 1000 亿美元的项目。我正在尝试计算一下装机容量(以吉瓦为单位)。我数了一下,大概有八九个,Anthropic 有三个,OpenAI 有一个,所以是四个。你们说 Meta 有好几个,所以至少有两个,这样就包括 Tomahawk 6。我估计 Google 的规模应该比 Meta 大。所以至少有三个,加起来是九个,然后你们还有一些其他的。我以为你们每吉瓦的内容价值大概在 200 亿美元左右。我想问的是,我计算的你们计划在 2027 年交付的装机容量(以吉瓦为单位)是否正确?以及,随着交付量的增加,你们每吉瓦的内容价值应该如何计算?也许最终会远远超过 1000 亿美元。

总裁兼首席执行官 Hock E. Tan:

你的观点非常有趣,我得提醒你一下。你说得对,可以用吉瓦来衡量,这才是正确的衡量方式,而不是用美元,因为我们的芯片就是按吉瓦来卖的。所以你要明白,根狙桃们 LLM 的客户(现在是六个客户,抱歉,不是五个,是六个),每吉瓦芯片的价格会有所不同。有时差别相当大。确实会有差异。但你说得对,它和你说的美元价格相差不远。如果你以 2027 年的吉瓦为单位来看,我们预计会接近 10 吉瓦。

分析师 Stacy Rasgon:明白了,这很有帮助,谢谢。

操作员:接下来,我们将邀请来自 Melius Research 的 Ben Reitzes 先生提问。您的提问已接通。

Q7 分析师 Ben Reitzes:

嗨,谢谢。很高兴能和你交流。我想问问你关于 2028 年之前四大主要零部件供应前景的分析,你是怎么做的?你可能是第一个把预测延伸到 2028 年的人。其次,鉴于你的人工智能业务在 2027 年实现了惊人的增长,根据你之前的分析,你认为 2028 年的供应前景是否足以支撑业务的进一步增长?非常感谢。

总裁兼首席执行官 Hock E. Tan:

我能说的最好答案是,是的,你说得对。我们预料到了这种迅猛的增长。虽然没人能预料到目前的增长速度,但我们确实预料到了很大一部分增长,或者说,至少在未来六个月以上会持续增长。我们很早就掌握了光罩的锁定技术。如果你听说过我们之前提到的那个臭名昭著的光罩锁定,那我们绝对是最早一批掌握这项技术的。我们已经锁定了基质。我们和优秀的合作伙伴一起,在我们之前提到的其他方面都取得了进展。所以,对于你的问题,答案是:这在某种程度上得益于我们早期的预期,以及我们在这些关键组件领域拥有非常优秀的合作伙伴。除了“是的”之外,我还能说什么呢?查理,你还有什么要补充的吗?

半导体解决方案集团总裁查理·卡瓦斯:

是的,可能就简单提几个问题。我觉得你那部分讲得非常透彻。本,我认为还有一点非常重要,正如你所说,我们为六家客户定制芯片。我们与他们建立了非常深入的多年战略合作关系。由于这种定制能力,他们会与我们分享他们未来至少两到三年,有时甚至是四年内的具体预期。正因如此,我们才着手确保霍克提到的所有要素。而当我们确保这些要素时,就需要与这些合作伙伴进行投资,有时不仅要开发更大的产能,还要开发合适的技术和产能。所以我们必须确保未来几年的合作关系。而且我们可能是——你说得对,我们可能是第一家确保到 2028 年甚至更久的——公司。

分析师 Ben Reitzes:

以目前的供应情况来看,2028 年你能实现增长吗?不好意思,我突然问这个问题。

半导体解决方案集团总裁 Charlie Kawwas:是的。

分析师 Ben Reitzes:谢谢。

操作员:谢谢。接下来,我们将由美国银行证券的维韦克·阿亚先生提问。您的电话已接通。

Q8 分析师 Vivek Arya:

感谢您回答我的问题。霍克,我首先想澄清一下,您今年在 Anthropic 公司开展的项目,比如投资 200 亿美元建设 1 吉瓦的装机容量,其中有多少是芯片,有多少是机架式设备?我想了解的是,您提到的 1000 亿美元芯片项目,是指芯片项目还是机架式设备?因为仅机架式设备项目明年的规模就预计会扩大三倍。

那么我的问题是,您的人工智能业务正在从之前与一个大型客户建立的独家合作关系,转型为现在与多个客户合作,而这些客户使用多个供应商。由于这些客户分散在众多云服务提供商之间,合作模式非常分散,您如何才能清晰了解并自信地预测您在这些客户中的市场份额增长情况?您采取了哪些措施来确保您能够清晰了解这些分散的客户群体,并占据合适的市场份额?

总裁兼首席执行官 Hock E. Tan:

维韦克,首先,正如查理精辟地指出,我们的客户非常少,确切地说,只有六个。就我们目前的业务量和收入而言,我们只有六个客户,而且在此之前,客户数量更少。其次,我也必须明白,考虑到每个客户的消费金额以及他们所开展业务的重要性,我们很难全面了解他们的投入。正因如此,Meta 才推出了 MTIA,这是一个人工智能和客户加速计划。

对他们来说,就像对我在这个领域的每一位客户一样,这是一种战略布局,而非可选项。对他们而言,长期、短期、中期都是战略性的,极其重要的战略。他们不会止步不前,而且他们每个人都非常清楚,他们希望将这些定制芯片定位在 LLM 开发轨迹中的位置,以及如何开发推理技术以实现 LLM 产品化。这部分,我们非常清楚。至于 GPU、云、以及基于云的超高速计算业务,这些都属于事务性操作和可选项。所以,正如您所指出的,这确实令人困惑。

相信我,我们和我们的客户都不会这么做。他们非常注重战略,目标明确,他们清楚地知道自己要构建什么,以及每年想要构建多少产能。他们唯一考虑的就是:能否更快地完成。除此之外,一切都按照既定的路线图进行,具有很强的战略性和针对性。你看到的任何其他做法,对他们来说纯粹是投机取巧,只是为了增加选择的余地。所以,这一点非常明确。

分析师 Vivek Arya:关于澄清部分,Anthropic 的货架和芯片有什么区别?谢谢。

总裁兼首席执行官 Hock E. Tan:

我不太想回答这个问题,但我们一切都好。正如克尔斯滕所说,我们的资金和利润都很充足。

分析师 Vivek Arya:谢谢。

操作员:

谢谢。接下来的问题来自巴克莱银行的汤姆·奥马利。您的线路已接通。

Q9 分析师汤姆·奥马利:

大家好,感谢你们回答我的问题。我有一个问题问 Hock,一个问题问 Charlie。Hock,我知道你对前导部分的内容非常讲究,你也提到客户要求使用直连铜缆,速度达到 400Gbps,速率为 30s。你特别强调这一点有什么原因吗?尤其你还是 CTO 领域的先驱。Charlie,随着你客户群的扩大,我想和你合作的客户应该会使用可扩展以太网。你能不能谈谈可扩展协议,以及你对以太网未来发展的看法?谢谢。

总裁兼首席执行官 Hock E. Tan:

好的。不,除非——我只是想强调我们在网络方面的优势,我们的技术确实非常独特,能够帮助我们的客户,甚至包括那些使用跨平台 GPU(不仅仅是 XPU)的客户。也就是说,如果您正在运行并尝试创建 LLM,并创建您自己的 AI 数据中心,进行设计和架构,您肯定希望构建越来越大的域或集群,并且尽可能将 GPU 直接连接到 XPU。而实现这一点的最佳方式就是使用直连铜缆。这是延迟最低、功耗最低、成本最低的方式。因此,您应该尽可能地继续使用这种方式,尤其是在纵向扩展方面。在横向扩展方面,我们已经超越了横向扩展的范畴。我们使用光纤。这没问题。但我说的是机架集群领域的纵向扩展,您真的应该尽可能地使用直连铜缆。我们仍然基于博通的技术——尤其是在 XPU 到 XPU 甚至 GPU 到 GPU 的连接方面。我们可以用铜缆实现,而且可以将传输速度从 100G 提升到 200G,甚至 400G。我们现在已经实现了 400G 传输,而且铜缆传输距离足够远。我想说的是,你没必要急着去追求那些所谓的 CPO(铜缆运营商),即使我们是 CPO 的先行者,CPO 也会在适当的时候出现,不是今年,也许不是明年,但总有一天会到来。明白了吗?

半导体解决方案集团总裁查理·卡瓦斯:

是的。没错,霍克说得好。关于以太网,随着云计算的兴起,以太网在过去二十年里已成为所有云平台的实际标准。回顾后端网络的诞生,正如霍克所阐述的,两年前曾就应该使用哪种协议来实现所需的延迟和扩展能力展开过激烈的争论。当时,也就是 24 个月前,业界对此并不清楚。但我们很清楚,我们非常清楚答案应该是什么。而且,由于我们与合作伙伴的深入合作,他们向我们和整个行业明确表示,无论是 GPU 还是 XPU,以太网都是横向扩展的首选方案。没错,如今大家都在谈论使用以太网进行横向扩展。那么,说到纵向扩展,就像三四年前纵向扩展的情况一样,现在的正确答案是什么呢?我们不断听到和看到的答案都是:以太网。和去年一样,我们与多家超大规模数据中心运营商以及半导体行业的许多同行共同宣布,以太网扩展是正确的选择。我们相信这将是未来的发展方向。时间会证明一切,但我们正在进行的许多 XPU 设计都要求通过以太网进行扩展,我们很乐意为此提供支持。

分析师汤姆·奥马利:谢谢你们两位。

操作员:

谢谢。接下来,我们将由高盛的吉姆·施耐德先生提问。您的线路已接通。

Q10 分析师 James Schneider:

下午好,感谢您回答我的问题。Hock,很高兴听到您谈到除 TPU 之外的其他全定制 XPU 项目的进展。展望明年,我们可以假设这些项目主要面向推理应用吗?能否请您定性地谈谈相对于 GPU 的性能或成本优势,这些优势如何帮助客户进行如此大规模的预测?谢谢。

总裁兼首席执行官 Hock E. Tan:

谢谢。我们的大多数客户都从推理入手,因为这往往是最简单的入门途径。这并非出于其他原因,而是因为推理的计算量要小得多。此外,问题在于,既然可以使用定制的推理芯片(例如 XPU)更高效地完成任务,是否还需要通用的大规模稠密矩阵乘法 GPU?XPU 的性能更好,甚至不逊色,而且成本更低,功耗也更低。而这正是我们发现这些客户最初选择从 XPU 开始的原因。

但它们现在正处于训练阶段,我们的许多 XPU 都同时用于训练和推理。顺便说一句,它们是可以互换的,就像 GPU 不仅可以用于训练(它们可能更适合训练),还可以用于推理一样。我们看到的是,我们的 XPU 同时用于这两种用途。而且这种情况正在发生。但我们也很快看到,对于那些在实现完整 XPU 的过程中已经相当成熟的客户,他们将开始每年同时开发两款芯片,一款用于训练,一款用于推理,以实现专业化。为什么?因为我们非常清楚地看到,对于这些 LLM 厂商来说,进行训练是为了获得——为了让他们的 LLM 达到更高的智能水平。

太好了,你拥有了一款优秀的 LLM,甚至可以说是最先进的。现在你需要将其产品化,也就是实现推理功能。这时你就可以断定你的模型已经是最好的了,因为如果你现在才开始进行推理功能的产品化,至少需要一年的时间。而在此期间,其他人可能已经开发出了比你的更好的 LLM。所以,当你进行训练,以在 LLM 中创造更高层次的智能时,你必须同时投资于推理功能,包括芯片和容量。随着我们发现这六位客户在印度的 LLM 技术日趋成熟,并朝着更好的 LLM 迈进,我们的市场前景也越来越光明。是的,这就是我们观察到的趋势。虽然并非所有六位客户都如此,但我们看到他们中的大多数正在朝着这个方向发展。

操作员:

谢谢。稍等片刻,我们进入下一个问题。这个问题将由 TD Cowen 的 Joshua Buchalter 提问。您的线路已接通。

Q11 分析师 Joshua Buchalter:

大家好。感谢你们回答我的问题,也祝贺你们取得的成果。我非常感谢你们详细阐述了针对特定客户的部署预期。我希望你们能谈谈过去一两个季度以来,你们对项目的可见性有哪些变化,从而让你们更有信心提供更多细节。另外,你们提到 OpenAI 在 2027 年的装机容量将超过 1 吉瓦。考虑到该协议涵盖 2029 年之前的 10 吉瓦装机容量,我猜这意味着 2028 年将会有一个相当大的增长。我的理解对吗?这是否一直是你们的计划?谢谢。

总裁兼首席执行官 Hock E. Tan:

是的。嗯,没错,正如大家所见,也正如大家所知,我们现在正处于一场生成式人工智能的竞赛之中——我不应该用“竞赛”这个词,我们不妨称之为几家厂商之间的竞争。我的意思是,这的确是一场竞争。每家厂商都在努力打造比对方更优秀、更适合特定用途的大模型(LLM),无论是企业级、消费级还是搜索级,他们都在不断改进。而这一切不仅需要训练(这对于持续改进 LLM 模型至关重要),还需要推理来实现 LLM 的产品化和盈利。我们再次强调(或许应该称之为“IT”),我们已经与其中一些厂商合作超过两年了。随着他们越来越相信与我们合作开发的 XPU 能够实现他们的目标,我们的影响力也越来越大。随着他们逐渐意识到正在开发的 XPU 及其所需的软件和算法,他们越来越有信心这款 XPU 芯片正是他们所需要的,而且情况会越来越好。正如查理所说,我们也能更清楚地了解进展,因为归根结底,我们仅6家核心AI客户。而正如我所说,这六个人都以非常战略性的方式看待 XPU 和人工智能。

他们并非着眼于一代又一代人的发展,而是着眼于未来数年,跨越数代人。尽管外界充斥着各种关于现有产品的喧嚣,但他们的思考却非常长远——他们着眼于如何部署与我们共同开发的经验,如何将其应用于构建他们想要打造的更优质的LLM,以及更重要的是,如何实现盈利。因此,我们是他们战略路线图的一部分。我们并非仅仅提供一些可选方案,比如“哦,我该用 GPU 吗?我该用云端吗?因为我需要训练六个月。”不,这远不止于此。他们的投资是长期的,能够参与到他们的长期路线图中,而不是仅仅参与到短期的交易路线图中,我感到非常荣幸。

正如我之前回答过的一个问题,噪音指的是很多短期交易干扰了我们业务和产品的长期战略定位。总而言之,我认为我们目前在 XPU 领域的业务对我们现有的六家客户来说都是一项可持续的战略举措。

分析师 Joshua Buchalter:

谢谢。

操作员:

谢谢。今天的问答环节到此结束。现在我想把电话交还给智宥,请她做最后的总结发言。

投资者关系负责人 Ji Yoo:

谢谢。博通目前计划于 2026 年 6 月 3 日星期三股市收盘后发布 2026 财年第二季度财报。博通财报电话会议的公开网络直播将于太平洋时间下午 2:00 举行。今天的财报电话会议到此结束。感谢各位的参与。Sree,你可以结束通话了。

操作员:今天的节目到此结束。感谢各位的参与。现在可以断开连接了。