造出最大芯片的公司 拿下今年全球最大IPO 首日涨70%

2026-05-14 19:26:11 · chineseheadlinenews.com · 来源: 腾讯科技

过去几年,AI 芯片行业有一个很有意思的现象,很多公司最初讲的故事,和后来真正活下来的原因,并不完全一致。

Cerebras,就是一个典型案例。

5月14日,Cerebras以每股185美元定价,募资约55.5亿美元,对应市值398.17亿美元。成为2026年迄今全球规模最大的IPO。上市首日暴涨近70%。

他讲的故事是:一颗刷新世界纪录的大芯片、一份超过200亿美元的OpenAI 合同、一个超过两亿美金的GAAP净利润。

但如果把 Cerebras 的故事拆分成两层:一层是技术与产品的真实位置,一层是IPO招股书里写在白纸黑字上的另一面,这个故事可能会给资本市场留下更多的未完待续。

一、一颗“Wafer-Scale 晶圆级”芯片

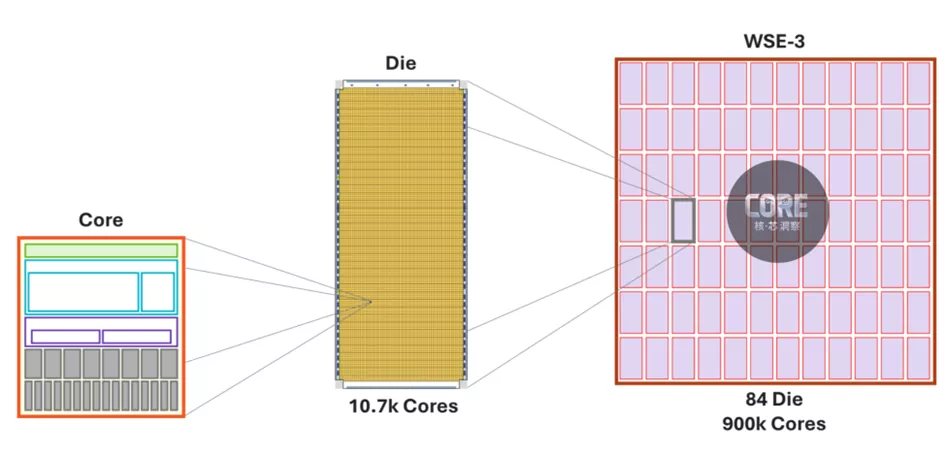

Cerebras 的核心产品叫Wafer-Scale Engine(WSE),它没有像 Nvidia、AMD、Google TPU那样把一颗Die切下来封装成芯片,而是把一整片12吋晶圆做成一颗芯片。

这在工程实现上挑战很大。

普通芯片受限于光刻机的Reticle大小(每次曝光最大版图面积约 858mm?),切出来的die面积是有限的,不能比Reticle更大。Reticle 之间有一条专门用来切割的线叫Scribe line,上面默认没有有效电路。Cerebras 与 TSMC 一起做了Cross-reticle stitching,让金属连线可以跨过 Scribe line,把多个Reticle大小的版图拼成一整片Wafer-Scale晶圆级的计算系统。单颗 WSE-3 上有约 90 万颗核心和44GB片上SRAM。

业内一直对Cerebras的Wafer-Scale存在着质疑,在硬件上主要围绕工程实现和良率展开的。

WSE涉及的版图设计、片上互联、缺陷绕行、PVT 一致性、散热、供电、封装,每一项都是工程上的硬骨头。客观地说,Cerebras把这些骨头啃下来了,这本身就是一项很强的工程成果,确实是实现了工程意义上的突破。

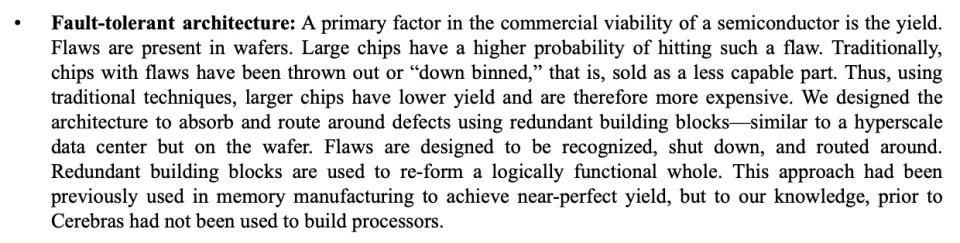

在良率上,Cerebras 对外宣称做到了 100%。可如果仔细研究其S1文件和公开的信息和资料,它实际上只是改变了良率本身的计算方式。

换句话说,他重新定义了芯片良率。

传统芯片的良率算的是一颗die是否如预期完整可用,只要落上一个致命缺陷,整颗芯片就会被报废或降级出售。Cerebras把良率的定义换了一种计算方式:整片晶圆能否通过冗余核心和片上网络绕过缺陷,最终凑出一个逻辑上完整的计算系统。根据S-1文件的描述:这是从 memory 行业借来的思路,DRAM/SRAM实际上就是靠冗余Row/column 把良率做到接近100%,Cerebras 也把这套做法搬到逻辑芯片上。

这倒不能说他完全是在偷换良率的概念,真要实现如此大面积上的系统可用性也很不容易。靠着片内互连和结构上的取巧,Cerebras实现了某种工程上的突破和产品层面的平衡。但说到底,它和传统 GPU 良率口径不在同一个度量衡里,并不能直接横向比较。

从Cerebras的视角来看,除了WSE, 还有一个显著特点,也是其多次强调的创新突破之处,那就是片内带宽极高。根据其公开说法,片上 NoC 带宽达到Pbps量级。

但如果仔细研究就会发现,只要数据需要离开晶圆,还是要面对其他 AI芯片面临的问题,片(卡)间带宽的瓶颈同样会出现,片内和片间互连的量级差大约在 100 倍以上。

我们分析,正是这种“内快外慢”的结构决定了WSE的“转向”故事。

二、训练梦碎,推理找到了新机会

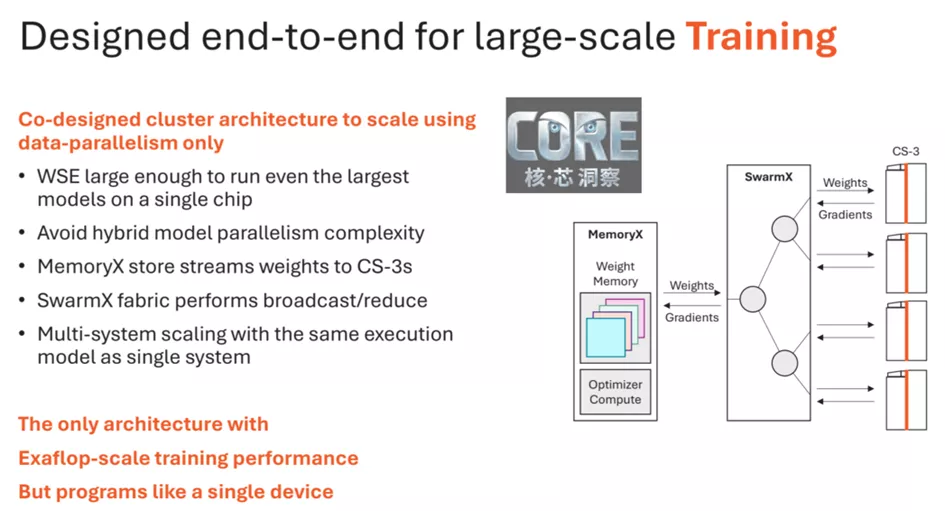

Cerebras 最早瞄准的是训练。站在今天回看,这件事没做成。

训练市场有三个绕不过去的约束。硬件:大模型训练拼的不是单芯片算力,是外部内存与外部互连,权重、梯度、optimizer state、activation 都要在大规模系统里高效搬运,而WSE恰恰在片外 I/O 互连上是短板。

软件:Nvidia 的真正壁垒在 GPU+CUDA+NCCL+NVLink+NVSwitch+HBM+服务器+云厂商部署+开发者生态共同搭出的整套系统,这种壁垒不是单点技术领先就能撼动。训练场景的客户基本上主要为全球大模型的头部玩家了,他们当下最大的战略任务是“留在牌桌上、争最快迭代”,没有人会用如此巨大的机会成本去赌一颗非Nvidia的训练芯片。

Cerebras当年为训练配了SwarmX和MemoryX,这其实一定程度上是借用了AMD的既有成果,挂在 WSE外面解决内存与扩展。但实际部署中这套配套基本没被认真用起来,根源还是那句话,WSE 的技术亮点在片内,AI 系统的真实瓶颈在系统,在模型如此规模化的今天,片间与片外的瓶颈,直接限制了系统的效能,进一步限制了应用场景。

它还押过一个更大的赌注:非结构化权重稀疏,理论上 8:1 任意稀疏可以拿到接近 8 倍的有效算力,在产品定义与设计上,要在AI计算的泛化意义上来实现,那是非常难的。但在实际上,大模型最后没走这条路,业界主流是 MoE、低精度量化(FP8/FP4/MXFP)、attention 优化。Cerebras 在硬件上尝试去做一个很难的特性,但这个特性没有成为模型演进的主路线。

这也再次证明,AI芯片产品经理要对AI模型有很深刻的理解和预判能力,不然的话,产品定义和设计,就会面临极高的风险。

三、推理成为“新金矿”

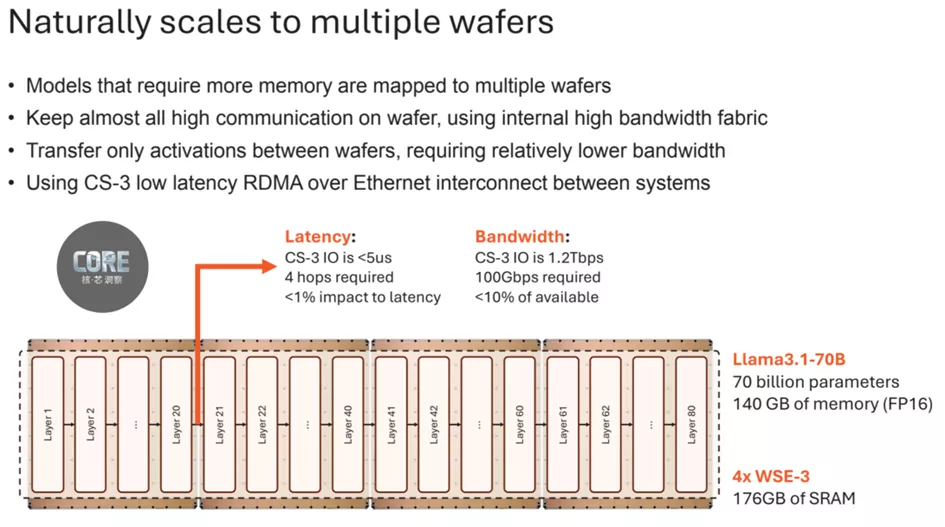

推理和训练的系统约束完全不同,推理和场景有关,其计算模式可以解耦。Cerebras 把推理任务做成一条流水线:把整个大模型按层切成几段,分别放到一片或多片 WSE 上;推理时数据像在工厂传送带上一样,从第一片 WSE 流到下一片,每片只负责自己那一段计算。

这套办法之所以能在 WSE 上跑通,关键在于一个细节,串接片与片之间需要传输的,只是这一步算出来的中间结果(activation),数据量相对较小;而真正吃内存的部分(模型权重、用户对话过程中累积的 KV cache)则被锁在每一片 WSE内部,不需要反复跨片搬运。

这恰好绕开了 WSE 最大的短板,片外 I/O 不够快(只是相对于片间来说,和其他 AI芯片其实也在同一个数量级上)。对追求高 token 吞吐的推理场景,这条路线的工程意义是真实的:Cerebras Inference在公开 benchmark上跑出了比主流GPU方案快约15倍的token速度。

但正如之前分析Groq的文章中所述,推理的强泛化能力几乎就难度极高了。

模型大小、结构、KV cache 需求差异极大,再加上 SRAM 容量、片外 I/O 这些底层约束,WSE 只能在“特定模型 + 特定适配”的场景下打出最强表现。它的最优市场策略,就应该是找到最通用的模型、量最大的HyperScaler客户,针对其计算系统进行软硬件的适配与优化,这也就意味着,从经济意义上来看,它必须挑客户。

到这里,技术故事讲完了。一颗工程上有真本事的大芯片,从训练市场退了出来,在推理市场找到了一条高吞吐路径,但这条路径必须靠少数大客户和深度适配才能走通。

在当今西方世界上,OpenAI和Anthropic是顶级模型大平台。

因此,接下来在S-1文件中,我们就看到了这个技术故事的另外一面。

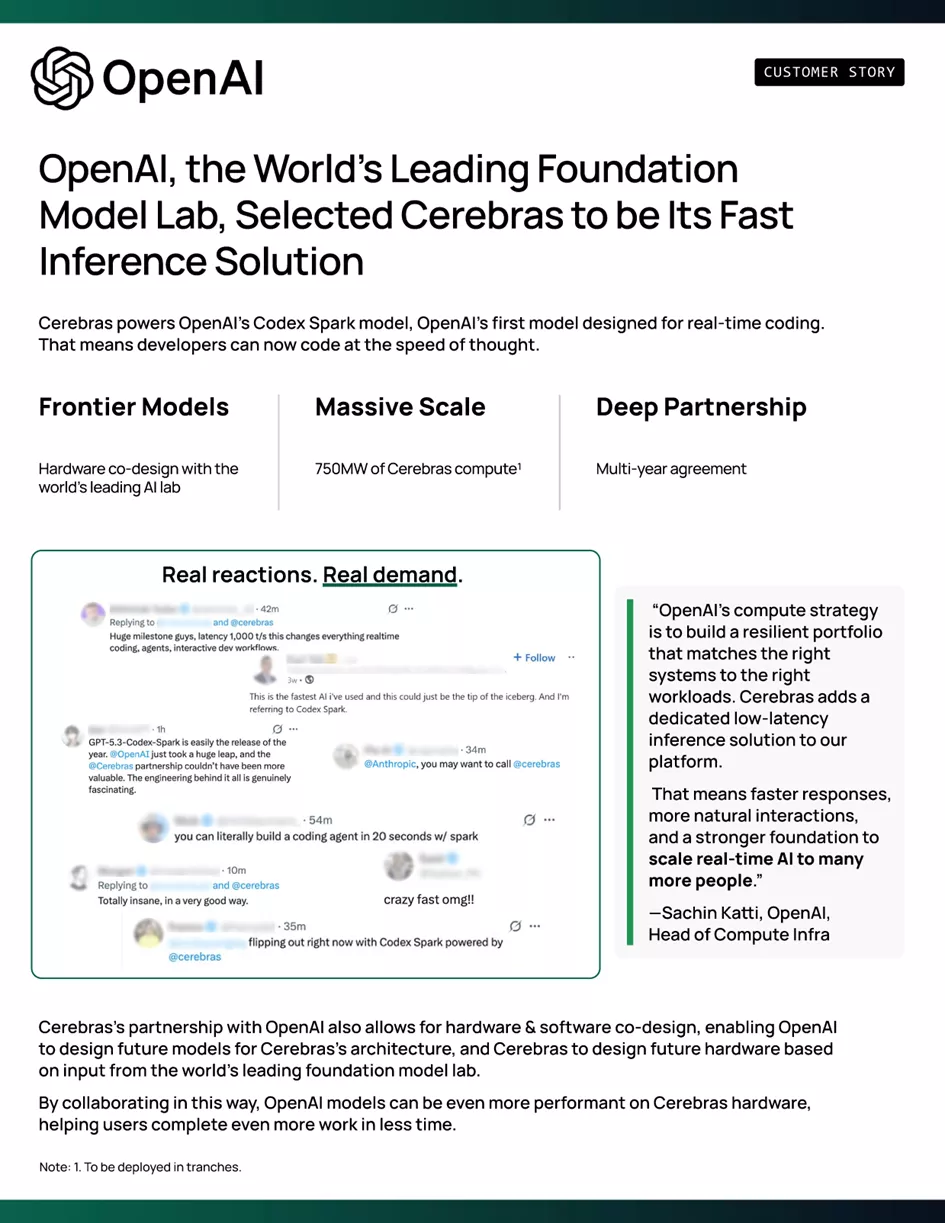

四、$200 亿订单的另一面:股权换订单

2026 年 1 月,Cerebras 公开宣布与 OpenAI 的多年合同,金额“超过 200 亿美元”,部署 750MW 高速 AI 推理算力,双方共同设计未来模型与硬件。这是 Cerebras IPO路演中很重的一句话。

在S-1文件中,这句话却成为了一组互相咬合的合同条款,需要拼起来才能看到全貌。

第一笔:$10 亿“工作资本贷款”。MRA(Master Relationship Agreement)签署后,OpenAI 借给 Cerebras $10 亿 secured promissory note,年利率 6%,到期日不晚于 2032/12。但这笔钱的账户由 OpenAI 控制,Cerebras 不能自由支配;如果MRA因为非 OpenAI 重大违约的原因终止,OpenAI 可以一键冻结这笔钱并要求立即全额偿还。还款方式特别,Cerebras 可以用现金还,也可以用算力、硬件或其他服务抵销贷款本金和利息。

第二笔:33,445,026 股 OpenAI Warrant。同一份MRA签订之时,Cerebras向OpenAI发行了一份认股权证:标的33,445,026股Class N普通股,行权价$0.00001 / 股,几乎等于白送。S-1 披露的授予日公允价值是$82.02 / 股,对应总价值约 $27.4 亿。Vesting 分三档:第一档 4,459,337 股,触发条件是 $10 亿贷款到账,已于 2026 年 1 月归属;第二档 5,574,171 股,触发条件是 Cerebras 上市后市值首次突破$400 亿、或 OpenAI 完成特定付款里程碑;第三档 23,411,518 股,按交付节奏分批归属,且完整归属的前提是 OpenAI 行使全部1.25GW Additional Capacity 选项、累计采购量达到2GW。

第三笔:Co-design义务 + 排他条款。MRA还包含一定排他性安排,限制Cerebras向OpenAI的部分特定竞争对手提供某些产品和服务。这意味着,Cerebras在获得OpenAI大单的同时,也在一定程度上让渡了部分潜在客户空间。

把这三件事放在一起看,OpenAI与Cerebras之间走的是一个完整的资金闭环:

OpenAI借出$10亿, Cerebras 用这笔钱采购Wafer、扩产能、租数据中心;然后Cerebras 把建成的算力卖回给 OpenAI;OpenAI不需要付现金,用应付货款抵销贷款本金。限期一年走完,OpenAI的现金没真正出去,Cerebras的现金也没真正留下,剩下的只有 OpenAI 拿到750MW 算力使用权 + 33,445,026 股 Cerebras N普通股的认股权证(OpenAI 同时签了 Registration Rights Agreement,行权后可要求Cerebras把股票登记上市流通)。

这是一笔以“算力期权 + 股权认购权”打包的交易,被会计准则切成三张表,但商业实质是同一笔生意。

作者声明:该图片由AI生成

S-1 在Note 4给出了会计处理依据:客户Warrant 按授予日公允价值,作为合同交易价格的扣减项(contra-revenue),随商品/服务交付按比例冲减收入。截至 2025/12/31,Cerebras 资产负债表上记入 $152.4M的 Customer Warrant Asset——但这部分几乎全部对应G42那笔 1,857,516 股Warrant(同样是阿联酋系客户,是不是似曾相识?可以参考上一篇有关Nvidia收购Groq的文章),并且OpenAI Warrant 在 2025 年财报里没有任何影响。

也就是说,Cerebras 2025 年报告口径里的所有收入与毛利率,都还没有扣过 OpenAI 这笔账。

按S-1在 Note 13的probable判断:第一档(已 vest)+ 第二档(probable)+ 第三档之 Committed 750MW的部分(probable),合计约 1900 万股,对应公允价值约$15.4 亿,这部分将从 2026 年 Q1 起按 OpenAI 收入比例陆续冲减 Cerebras 的报告口径收入。

Cerebras自己在 MD&A 里写:“When we begin to recognize contra-revenue amounts from the warrants in the first quarter of 2026, we expect quarterly revenue growth rates will decline from recent trends.”(当我们从 2026 年第一季度开始确认Warrant 对应的冲减收入时,预计季度收入增长率将较此前趋势放缓。)

全部OpenAI Warrant按授予日公允价值约27.4亿美元计算,其中约15.4亿美元对应已归属及被公司判断为probable的部分,将自2026年一季度起随OpenAI收入确认节奏冲减收入;剩余约12亿美元则主要取决于OpenAI是否行使额外容量选择权及后续交付进度。

这在其披露的另一个大客户Amazon的合作上也有类似的操作。

AWS与Cerebras在 2026 年3月签订的 binding term sheet 也包含一份 2,696,678 股、行权价 $100 的 warrant,按 7 年时间+采购量vest。但 OpenAI Warrant 在数量级、行权价折扣、与合同金额的比例上都更激进,它已经不再是客户激励,而是把客户做成了准股东。

这种模式也并不是Cerebras这种将要上市公司所独有。

今年2月24日,AMD与Meta达成了一项为期五年、总规模超千亿美元的战略合作,根据协议,Meta将在未来五年内部署6GW算力规模的AMD GPU集群。作为对价,AMD向Meta授予最多1.6亿股、约占总股本10%的业绩型认股权证,行权价仅为每股0.01美元的象征性水平。

同样的认股权证,同样的味道。

五、39%毛利率背后的会计幻觉

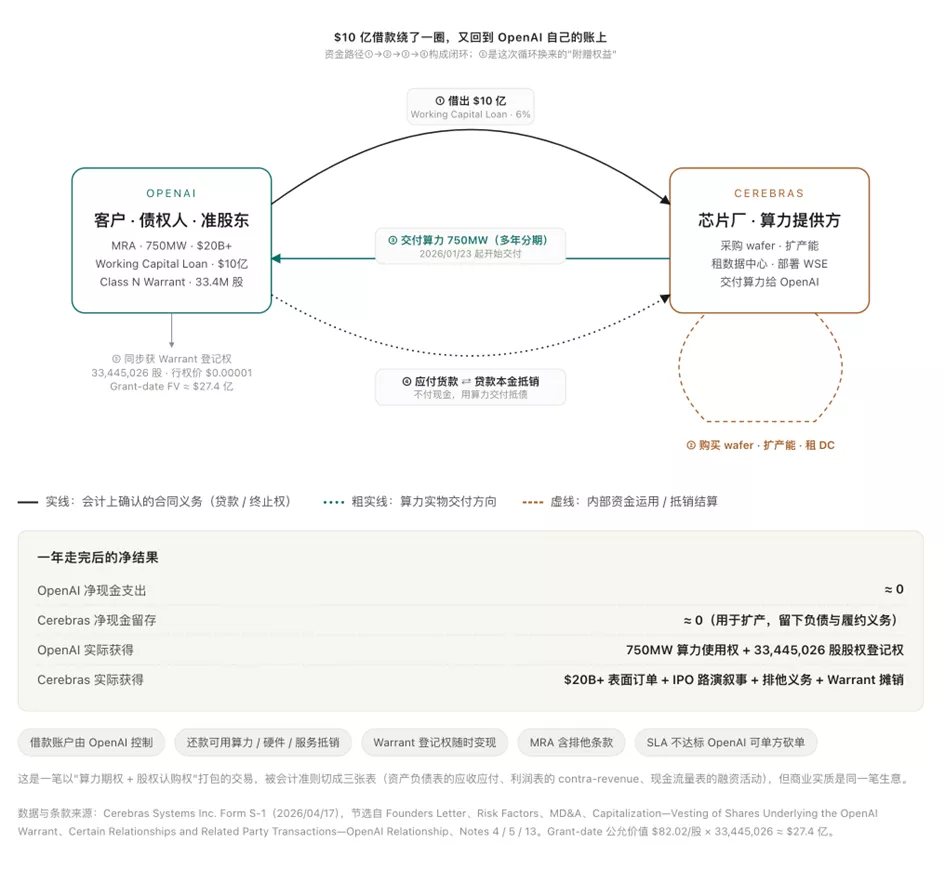

把视线从合同移到财务报表,S-1文件中披露的2025年关键数据:

作者声明:该图片由AI生成

GAAP 净利润 +$237.8M,这看上去Cerebras已经实现盈利。但仔细研究S-1文件给出的完整解释会发现,其中包含了一笔一次性 +$363.3M的一次性会计重估。剔除这笔会计重估和股权激励,Non-GAAP 净亏损$75.7M,同比扩大约 $54M。2024 年 +$452M的经营现金流主要靠客户预付款(G42、MBZUAI 提前付款 $640M),2025 年因为预付款消化反转成了-$10M。

$237.8M的盈利,其实是一个会计幻觉,实际上Cerebras仍在加速亏损。

再看毛利率,从2024年的42.3%降到2025年的39.0%,其在MD&A里提到云业务占比上升,与数据中心成本相关的项目也稀释了毛利,与此同时,未来还将出现客户认股权证冲减收入。换句话说,这39%的毛利率,毛的有点毛骨悚然:上市后,OpenAI 和AWS的认股权证所带来的的影响一旦从 2026 年 Q1 开始确认,毛利率算起来就更低了。

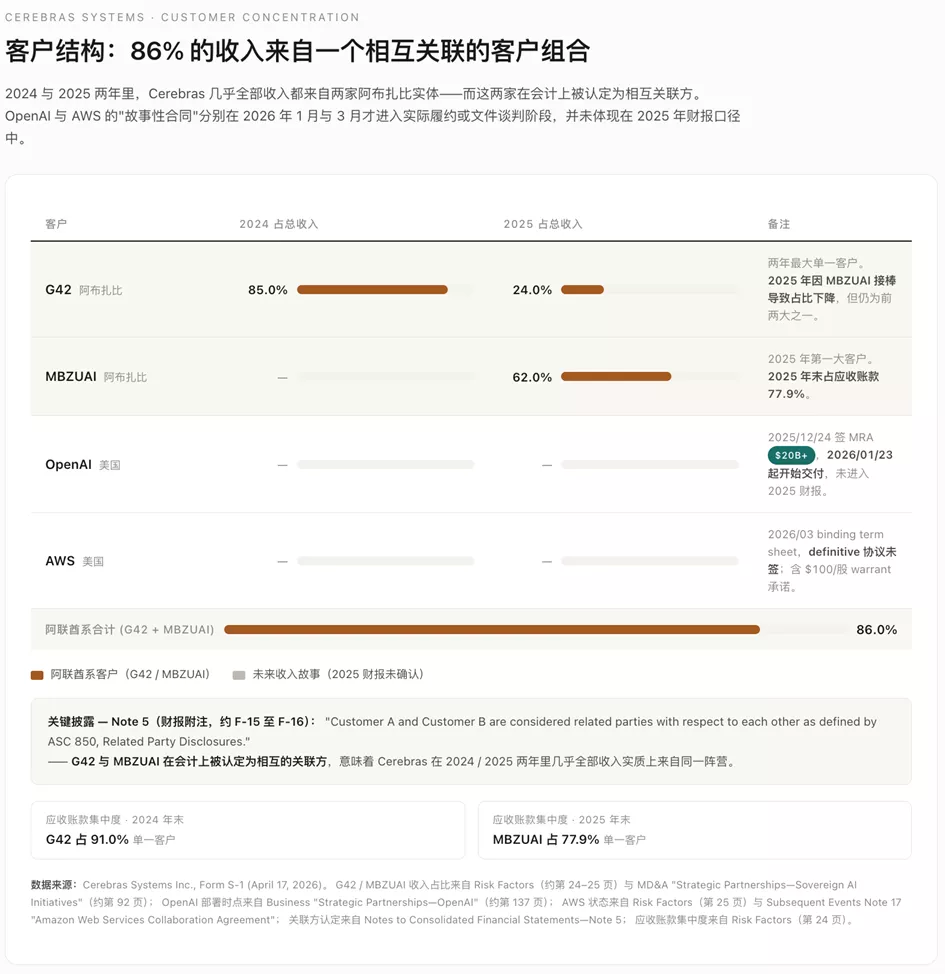

更需要被研究的是客户结构。

正如前面技术分析中所述,所谓在推理领域找到的机会,是要先决条件的!

作者声明:该图片由AI生成

S-1中附注的Note 5里明确写到:G42和MBZUAI在ASC 850下被认定为相互的关联方。也就是说,Cerebras在2024和2025两年里,几乎全部收入都来自一组在会计上可以视为“同一客户阵营”的阿布扎比实体。应收账款来看集中度更夸张——2024 年末G42占91%的应收账款,2025 年末MBZUAI占 77.9%。

从整个客户组合来看:2025年86%的收入来自一个相互关联的阿联酋客户组合,剩余约 14% 是其他长尾客户,OpenAI在2025年财报里还没有真正开始确认收入。Cerebras 当下的产品需求被锁在一个非常窄的客户面里,而向前看,IPO 之后的收入故事高度依赖 OpenAI——而 OpenAI 这个故事,又必须用Warrant 当作配套条件才成立。

这就是一家在上市前投资份额被疯抢的明星AI芯片公司的真实技术、产品、客户、营收和利润状况!

六、留给资本市场的五个问号

Wafer-Scale Engine算是过去十年最有辨识度的AI芯片项目,后期重新定位的“超高速推理”作为产品定位也跑出了市场——OpenAI 的 Codex-Spark 模型在 2026 年 2 月已经跑在了Cerebras上对外服务。在Nvidia锁死训练侧、推理侧仍存在多种架构机会的当下,在全球资本市场为AI产业疯狂砸钱的当下,Cerebras选择此时上市,也是煞费苦心。

但如果在二级市场真金地白银投票,还是要在这些故事之外,仔细研究几个非常具体的问题。

问号一:剔除股权对价后的真实毛利率是多少? 2025年的39%是没有扣 OpenAI Warrant 一分钱。Probable 部分约 $15.4 亿即将从 2026 年 Q1 起按比例冲减收入;如果 IPO 后股价进一步抬升,未来新增 vesting tranche 的公允价值会更高、对收入的拖累会更深。

问号二:$200 亿 OpenAI 订单到底锁定了多少?MRA 同时把“OpenAI 单方按 SLA 砍单的权利、Working Capital Loan 抽贷的权利、Additional Capacity 是否行使的选择权”全部交给了 OpenAI。Cerebras 履约不达标,订单可被部分或全部终止;Additional Capacity 不行使,Warrant 第三档 B 那 14,632,199 股作废、合同金额也大幅缩水。这份合同的下限,远低于“$200 亿”这个数字给人的直觉。

问号三:客户结构能不能从“主权 AI 项目承包商”切换为“AI推理基础设施公司”?2024–2025 两年 86%–85% 的收入来自互为关联方的 G42 + MBZUAI 组合,收入集中度太高。这种集中度在传统工业品业务里可以被解释为"早期单点突破",但对一家标榜为世界顶级AI芯片公司来说,它意味着估值锚是不稳定的。OpenAI 的引入能否在2026–2027年真正稀释这种集中度,要看后续的实际收入分布——而不是合同金额和市场叙事。

问号四:WSE-4 能不能补齐架构层面的短板?当前 WSE-3 有三个工程缺口:缺乏 FP8 / MXFP / FP4 等低精度浮点支持、片外和片间互连的带宽极度不带等远不够支撑大模型 KV Cache、以及其核心粒度太小傍编译器和数据映射带来高复杂度。Cerebras 自己也承认推理经济性高度依赖片上 SRAM。如果 WSE-4 不完成数量级别的改善,超高速推理的故事就不那么完备。产品层面客观地说,在芯片硬件既定的情况下,软件无法进行数量级别地优化系统能力,毛利率的改善必须靠硬件架构层面实打实地获取!

问号五:这套“认股权证(Warrant)换订单”的模式,二级市场愿不愿意买单?Meta 接受过 AMD 的Warrant,AWS也拿了Cerebras的Warrant,OpenAI 拿了Cerebras 更激进的Warrant,国内已上市和正在IPO的几家AI芯片公司也在用各自版本的客户股权激励换订单。

这个模式正在变成AI芯片公司上市的必备模式。

这种模式它能不能每次都跑成功,且一直可以跑下去,我们需要拭目以待。这次Cerebras的IPO,会是这个模式在国际资本二级市场上进行的压力测试。