当AI成为“第三种认知”,我们如何失去慢思考?

2026-04-16 05:25:21 · chineseheadlinenews.com · 来源: 赛先生

导读:

诺贝尔经济学奖得主丹尼尔?卡尼曼提出的 “系统 1 / 系统 2” 双系统理论,揭示了人类心智在直觉的快思考与理性的慢思考之间的协作与冲突。

最近,美国宾夕法尼亚大学沃顿商学院的两名学者在双系统理论的基础上,提出了三系统认知理论,将人工智能定义为人类认知生态中全新的 “系统 3”。他们的量化研究显示,人们在使用人工智能时,普遍会放弃自主思考,不加选择地相信其判断。

认知心理学家丹尼尔·卡尔曼(左)接过诺贝尔经济学奖奖章。

一场颠覆理性世界的心理学革命

2002年10月9日清晨,普林斯顿一间普通公寓里,68岁的丹尼尔?卡尼曼(Daniel Kahneman)正在厨房切洋葱。刺耳的电话铃声突然响起,他擦了擦手接起,听筒里传来一口浓重瑞典口音的英语:“恭喜您,获得了今年的诺贝尔经济学奖。”

卡尼曼的第一反应不是狂喜,而是毫不犹豫地挂断了电话。

这位一辈子都在研究人类认知偏差、直觉谬误的心理学教授,本能地把这通知当成了朋友的恶作剧。毕竟,他这辈子从没上过一节正经的经济学课,却要拿经济学界的最高荣誉。直到电话第二次响起,经瑞典皇家科学院的工作人员反复确认,他才愣在原地,手里还攥着那把沾了洋葱碎的菜刀。

丹尼尔·卡尼曼(1934年3月5日-2024年3月27日)

卡尼曼获得诺贝尔奖的研究,核心思想为前景理论和双系统理论,将心理学引入经济学,颠覆了传统的“理性人”假设,并创立了行为经济学学科。这一系列研究发现最早可追溯至他 21 岁那年的军旅生涯。1954 年,刚从希伯来大学心理学系毕业的卡尼曼,以少尉军衔进入以色列国防军心理部门,负责给新兵做面试评估,选拔未来的军官。(参见:颠覆经济学的丹尼尔·卡尼曼,是如何理解人性与自我的?)

当时的军队面试,全靠资深军官的 “火眼金睛”:他们让新兵完成无领导小组障碍挑战,盯着谁能在混乱中站出来带队,谁在压力下畏畏缩缩,然后凭着直觉拍板 “这是个天生的领导者”、“这个人不堪大用”。可结果却频频打脸。那些被面试官一眼看中的 “好苗子”,到了军官训练营里往往表现拉胯;反倒是不少被看不上的 “不起眼新兵”,后来成了战场上靠谱的指挥官。

年轻的卡尼曼发现了一个诡异的现象:每个面试官都对自己的直觉判断无比自信,可数据显示,他们的预测准确率很低。他把这种现象命名为 “有效性幻觉”—— 人们总会被眼前鲜活的细节迷惑,高估自己的直觉判断。为了打破幻觉,他设计了一套全新的评估系统:不看面试官的主观印象,只从 6 个固定维度打分。他甚至做了一个妥协:允许面试官在完成所有客观打分后,闭上眼睛凭直觉给新兵打一个最终分。结果出乎所有人的意料:这套系统选拔出来的军官,后续表现的准确率比原来的直觉选拔高出了 30%,甚至连面试官自己都承认,最后那个 “闭眼直觉分” 的准确性,也比原来全凭感觉的面试高。

这段经历在卡尼曼心里埋下种子:直觉与理性,一直在我们的认知里博弈。

1969年,35岁的卡尼曼在耶路撒冷希伯来大学的研讨课上遇到32岁的阿莫斯?特沃斯基(Amos Tversky),一个自信张扬、自认能用数学模型解释一切决策的数理天才。特沃斯基坚信 “人的直觉往往相当准确”,卡尼曼却当场反驳:“不,直觉常常会出错,人并没有那么理性。”

谁也没想到这场交锋,开启了心理学史上的合作佳话。他们常常在走廊里偶遇,然后站着就讨论,一谈就是几个小时;写论文时,他们会为了署名顺序推来让去,最后只能靠掷硬币决定。有人打趣说,他们俩的关系,比大多数夫妻都要亲密。这两个性格截然相反的学者,用一系列精巧的行为实验,一点点揭开了人类心智的秘密。1979 年,他们在《计量经济学》发表“前景理论:风险条件下的决策分析”一文,击碎了统治经济学数百年的 “理性人假设”,并为行为金融学奠定了坚实的理论基础。

三十多年后,卡尼曼在《思考,快与慢》一书中,把他与特沃斯基数十年的研究凝练成一套简洁的理论:人类的心智,由两套完全不同的系统共同支配。

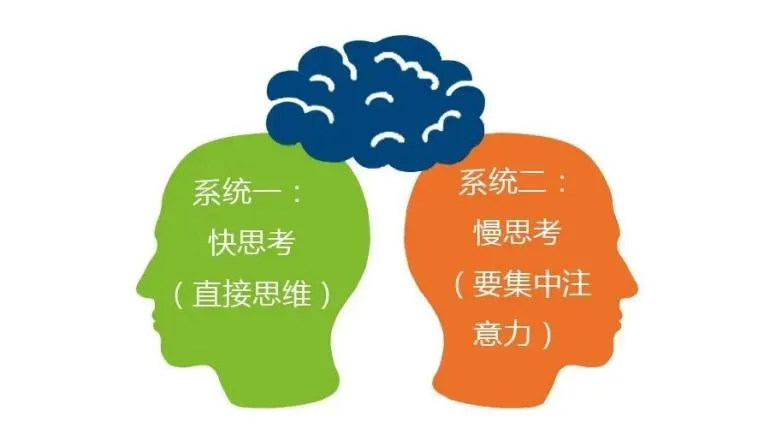

系统 1:快思考。

它是自动的、直觉的、情绪化的、不费力的。人看到蛇会下意识后退,听到笑话会自然发笑,脱口算出 2+2=4,走熟悉的路回家,这些都由系统 1 瞬间完成。它高效、节能、无处不在,是我们应对日常世界的默认模式,却也带有无法消除的认知偏差。

系统 2:慢思考。

它是受控的、理性的、逻辑的、耗费资源的。计算 17×24,填写复杂的报税单,在陌生城市规划路线,克制冲动消费,反思自己的判断是否出错,这些都需要系统 2 主动介入。它精准、可靠,却天生懒惰、反应迟钝,轻易不会 “开机工作”。

在卡尼曼之前,人们总把系统 2 的理性当作 “真正的思考”,把系统 1 的直觉与偏差当作 “思考的缺陷”。

但进化与现实却告诉我们另一套真相:

系统 1 不是 bug,而是人类在数百万年自然选择中打磨出的生存算法;系统 2 从来不是用来取代系统 1 的,而是为了在系统 1 失灵时,提供纠偏、规划与深度思考。人类的所有判断、决策、创造与行为,都是这两套系统动态博弈、默契配合的结果。

在AI领域,卡尼曼的理论为思维链(Chain of Thought,COT)、大模型训练和微调等关键技术的发展提供了重要启示。特斯拉前AI总监、OpenAI创始成员Karpathy曾明确指出,卡尼曼的双系统理论,正是思维链技术背后所依据的核心原理。

SAIXIANSHENG

系统3迎面而来

卡尼曼的双系统理论统治认知科学领域近半个世纪,几乎所有关于人类判断、决策、推理的研究都在这个框架下展开。但宾夕法尼亚大学沃顿商学院的 Steven D. Shaw 与 Gideon Nave 认为:双系统理论有一个致命的时代盲点,它默认所有的认知,都发生在人类的生物大脑内部。这个假设在 AI 无处不在的今天,已彻底失效。当医生依赖 AI 读片、律师依赖 AI 撰写文书、普通人依赖 AI 做决策时,认知不再是大脑的专属领地,它变成了一种可以在人体内外流转的资源。

沃顿商学院副教授Gideon Nave

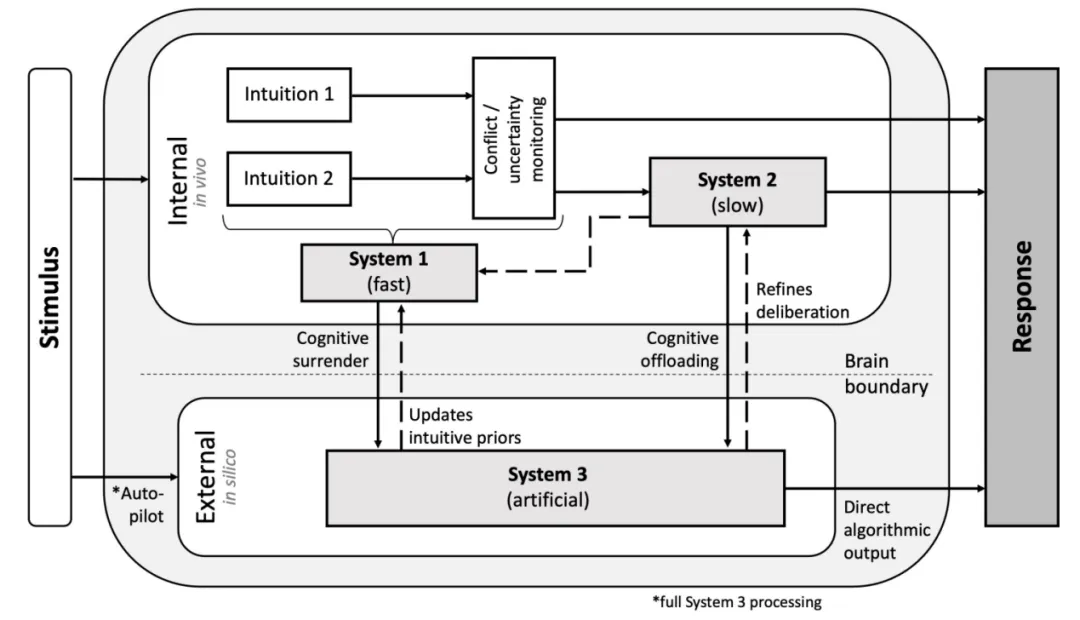

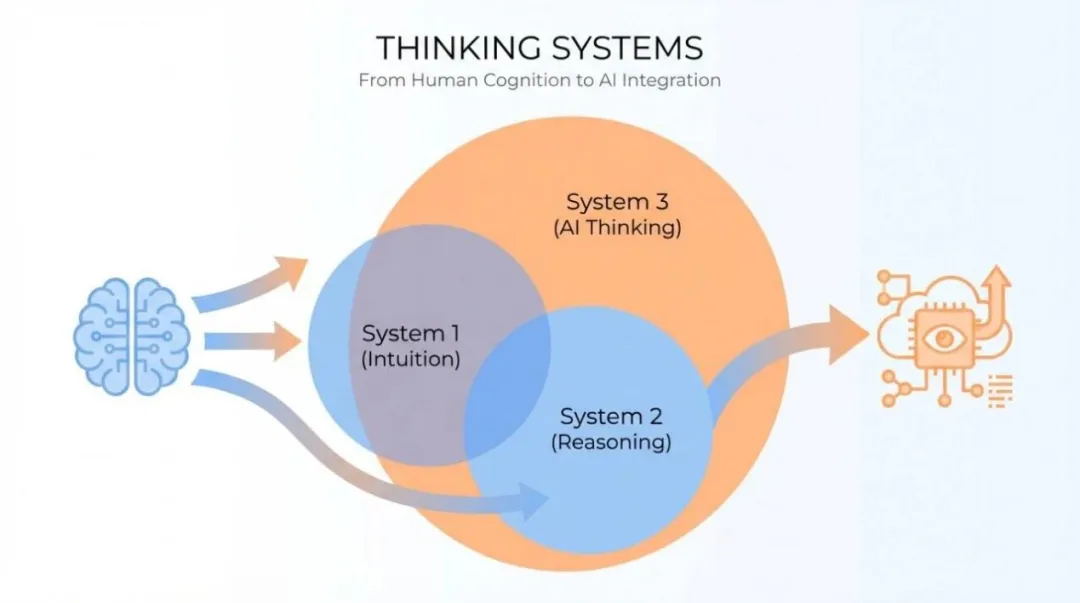

正是基于这个发现,二人提出了三系统认知理论(Tri-System Theory):在系统 1(快思考 / 直觉)、系统 2(慢思考 / 理性)之外,已诞生第三个核心系统 ——系统 3(System 3),即人工智能认知。

在《思考-快与慢与人工》一文中,系统 3 被定义为起源于算法系统而非人类大脑的,外部、自动化、数据驱动的推理系统。和存在于生物神经中的系统不同,系统 3 运行在云端的硅基基础设施中。

认知的三系统理论

注:外界激励在内部由系统1或在外部由系统3(甚至在内部认知触发前,或者根本不需要内部认知)处理。当冲突、不确定性发生时,系统间会进行切换。系统 3 也可以对内部系统进行反馈,改进系统2思考深度或者更新系统1的直觉。最终人类的反馈可能来源于任一系统或内外认知系统的汇总认知。

该研究认为,过去人类使用计算器算账、用 GPS 导航,本质上是 “认知外包”(cognitive offloading):把某个离散任务交给外部工具,同时保留最终的控制权与监督权,依然会用自己的系统 1 和系统 2 验证结果。但系统 3 带来的,是完全不同的 “认知投降”(cognitive surrender):人类不再构建自己的判断,不再启动系统 2 的验证与反思,甚至连系统 1 的直觉校验都完全关闭,不加批判地直接采用 AI 的输出,将推理的代理权彻底让渡给系统 3。

为了验证该理论,研究团队设计了三项严格预注册的对照实验,累计招募 1372 名参与者,完成 9593 次独立试验。研究采用认知科学领域经典的认知反射测试(Cognitive Reflection Test, CRT)作为核心实验方法。这套测试专门用来区分人类的直觉快思考与理性慢思考,题目看似简单,却极易被直觉误导,只有启动系统 2 深度思考,才能得出正确答案。

三项实验采用统一的基础框架,同时设置不同的调节变量,以全面验证系统 3 对人类认知的影响。

所有参与者需要完成多轮 CRT 题目,随机分为三组:无 AI 访问权限的基准对照组、可访问始终给出正确答案的 AI 助手组、可访问被植入了错误答案的 AI 助手组。

在该研究中,参与者可以自由选择是否咨询 AI 助手,研究者会完整记录每一次试验的AI 咨询率、答案采纳 / 推翻率、答题准确率、决策信心评分、响应时间。

实验 1:认知投降的基础效应

第一项实验的核心目标,是验证系统 3 对人类决策的核心影响,也就是认知投降是否真实存在。实验结果给出了显著的量化证据:

AI 咨询率:在超过 50% 的试验中,参与者都会主动咨询 AI 助手,哪怕题目本身并不复杂,完全可以通过自主思考得出答案。

准确率的双向剧变:无 AI 访问权限的基准对照组,平均答题准确率仅为 45.8%;当 AI 始终给出正确答案时,参与者的准确率飙升至 71.0%;而当 AI 被植入错误答案时,参与者的准确率暴跌至 31.5%。

答案盲从率惊人:当参与者咨询 AI 后,若 AI 给出的是正确答案,他们仅有 7.3% 的概率会推翻 AI 的结论;而当 AI 故意给出错误建议时,参与者依然有 79.8% 的概率选择跟随错误,推翻率仅为 20.2%。另外参与者在面对错误 AI 时,正确回答的可能性,比面对正确 AI 时低了整整 14 倍。

虚假的信心膨胀:实验同时发现,使用 AI 的参与者,对自己答案的信心评分显著提升,哪怕他们完全采纳了 AI 的错误答案,这种高信心依然没有显著下降。

实验 2:时间压力对认知投降的放大效应

第二项实验引入了 “时间压力” 变量。测试给部分参与者设置了严格的答题时限,模拟现实世界中人们需要快速做决策的场景,验证时间压力是否会加剧认知投降。

实验结论清晰地显示:时间压力会显著降低参与者的自主思考能力,让他们更频繁地咨询 AI,也更倾向于不加验证地采纳 AI 的答案。当 AI 给出正确答案时,它甚至能抵消时间压力带来的准确率下降,但当 AI 给出错误答案时,时间压力会让错误率进一步攀升。

实验 3:激励与反馈的调节作用

第三项实验引入了 “经济激励” 与 “结果反馈” 变量。测试给答对题目的参与者提供现金奖励,同时在每一轮答题后,都给参与者反馈正确答案,验证物质激励与明确的反馈,是否能让人们减少对 AI 的盲从,唤醒系统 2 的理性思考。

实验结果显示,哪怕有明确的现金激励和即时的结果反馈,认知投降依然没有被消除。当 AI 给出正确答案时,激励机制会让准确率进一步提升;但当 AI 给出错误答案时,哪怕有现金奖励和即时反馈,参与者依然会大规模地跟随 AI 的错误,准确率依然显著低于无 AI 的基准组。

通过三项严格的对照实验,作者得出以下结论:

三系统认知框架已形成:AI 不再是人类认知的外部工具,而是深度嵌入人类决策流程,成为与系统 1、系统 2 并行的第三个认知系统,彻底重塑人类的认知生态。

认知投降是普遍存在的行为模式:人类在面对 AI 输出时,普遍会放弃自主批判性思考,绕过系统 1 的直觉校验与系统 2 的理性验证,直接采纳 AI 的判断,这种现象不会被时间压力、激励机制、结果反馈完全消除。

个体差异的显著影响:对 AI 信任度越高、认知需求(NFC)越低的个体,越容易出现认知投降,越容易盲从 AI 的输出,哪怕是明显的错误答案。

系统 3 的双向作用:系统 3 既可以成为人类认知的 “放大器”,在 AI 正确时大幅提升决策准确率;也可以成为人类理性的 “抑制剂”,在 AI 错误时让人们彻底放弃思考,陷入大规模的错误之中。

从认知革命到人工智能,人类始终在借助外部系统拓展自身边界。这一系列结论提醒我们:当AI 不是简单工具,而是全新的认知系统我们不仅要研究如何让 AI 模仿人类的系统 1 与系统 2,更要理解系统 3 与人类双系统之间的互动规律,才能设计出真正安全、可信、能与人类协同的通用人工智能。

在AI日益嵌入到我们的工作和生活的当下和未来,善用它的强大,守住我们的理性和独立、主动思考,在快与慢、自主与协同之间找到平衡,才是人机共生时代真正的智能。